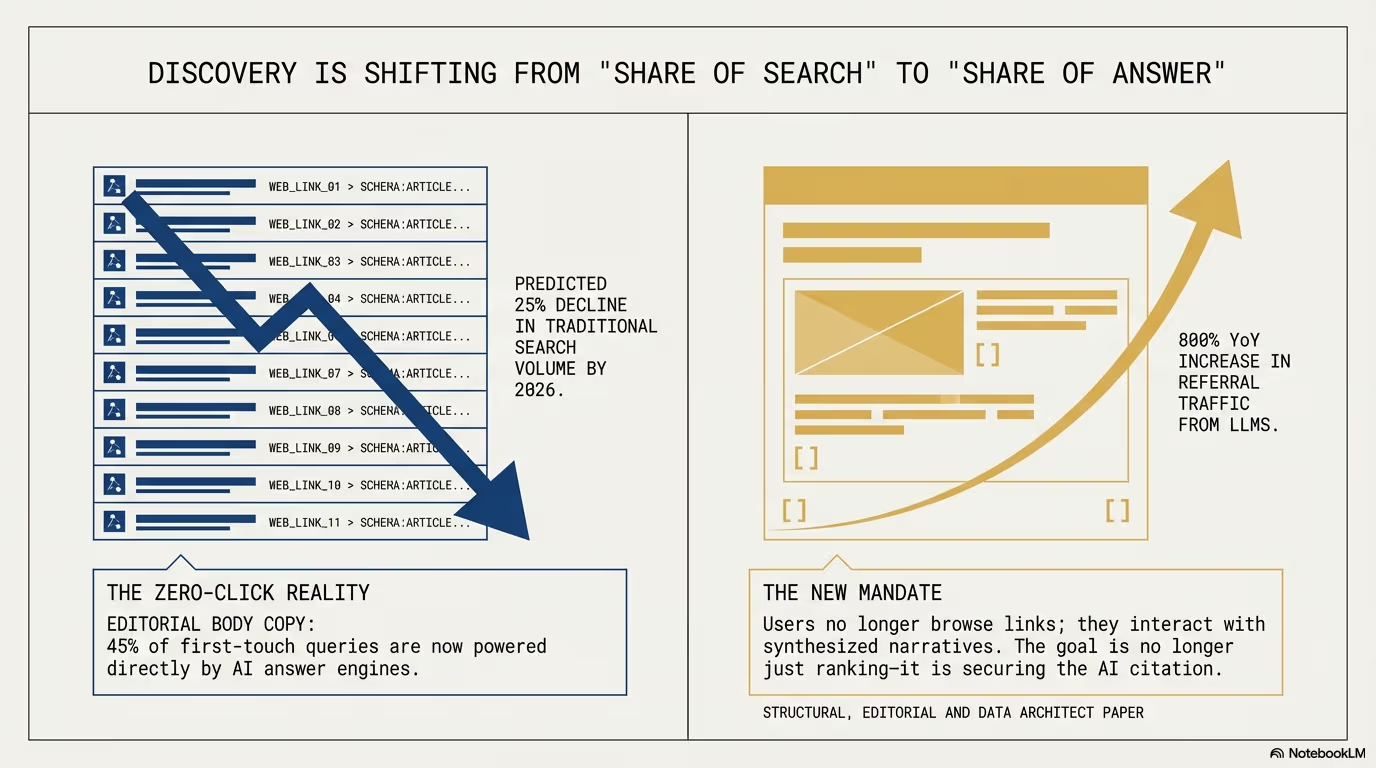

Innen 2026 har AI-søk erstattet den bla lenken som den primaere porten til informasjon. Gartner anslo et 25% fall i tradisjonelt sokevolum, og med AI-henvist trafikk som vokser 527% ar-over-ar, definerer disse 7 sannhetene overlevelse i zero-click-eraen. A forsta disse prinsippene er avgjorende for enhver virksomhet som er avhengig av organisk synlighet, fordi reglene for oppdagelse har blitt skrevet om fra grunnen av.

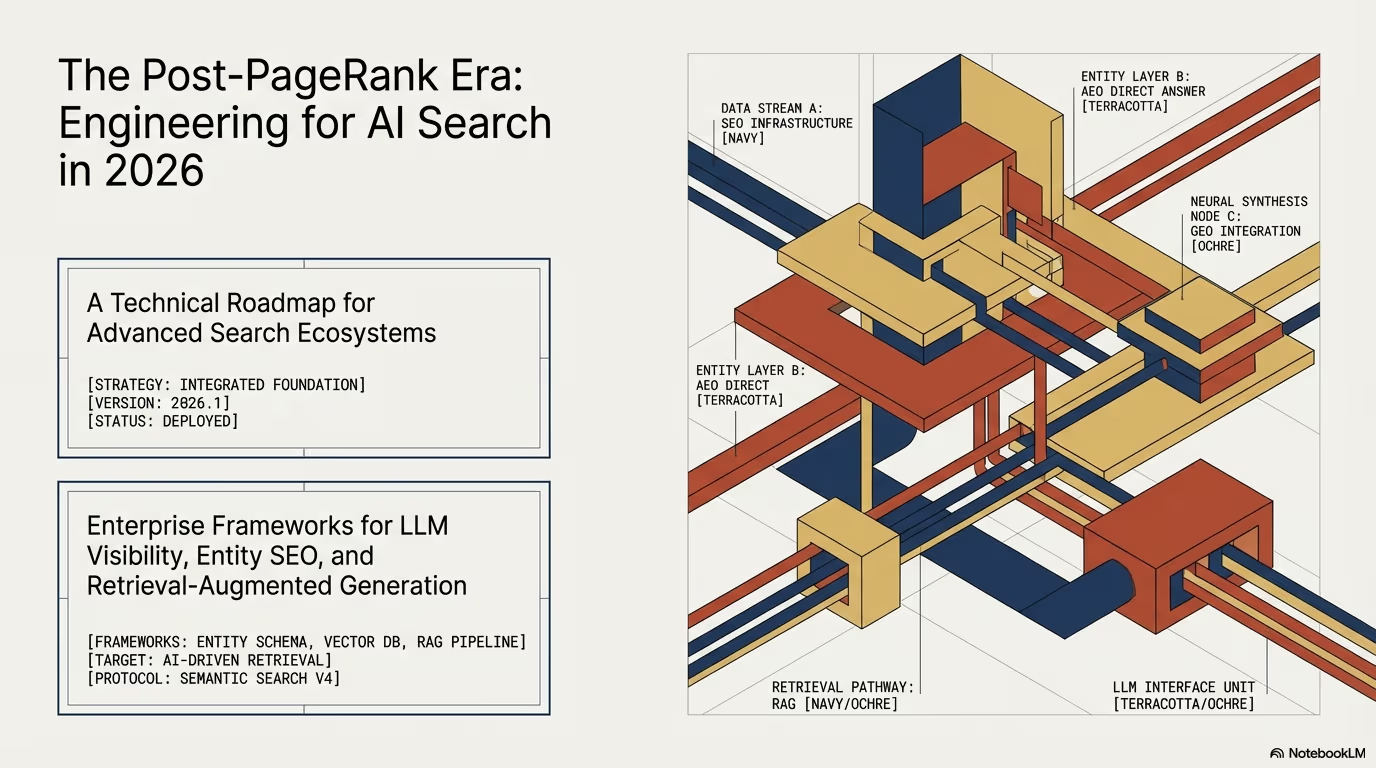

Overgangen fra SEO til GEO

Det digitale landskapet har gjennomgatt et tektonisk skifte. I tiår var den bla lenken internettets primaere valuta, men den eraen er over. Vi har beveget oss forbi sokemotoren og inn i svar-motorens tidsalder. Gartners prognose om et 25% fall i tradisjonelt sokevolum innen 2026 har i stor grad blitt realisert, og bevisene er overalt: brukere jakter ikke lenger gjennom ti bla lenker på en resultatside. De har kontekstrike samtaler med AI-systemer som syntetiserer informasjon og leverer svar direkte.

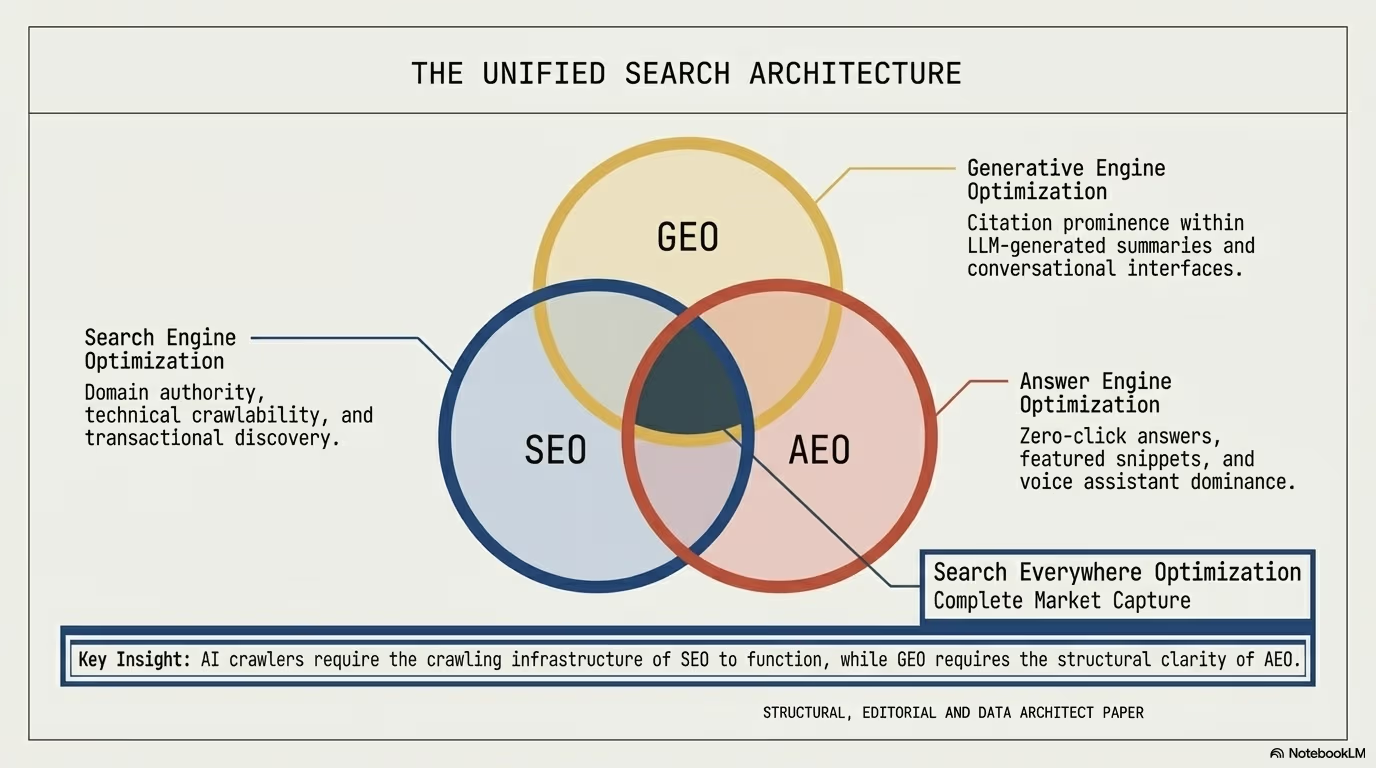

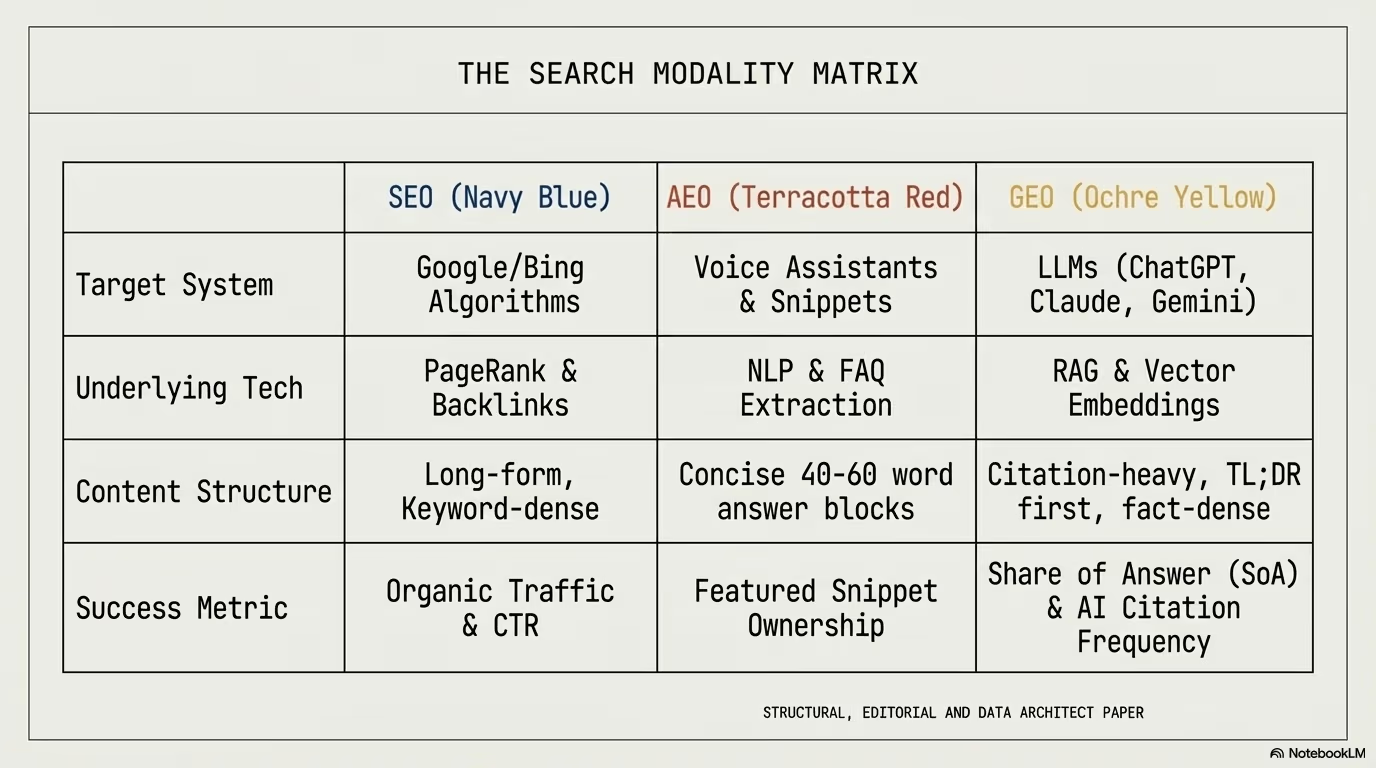

Dette er overgangen fra Search Engine Optimization (SEO) til Generative Engine Optimization (GEO). I dette nye paradigmet handler synlighet ikke om a rangere som nummer en på en liste. Det handler om a bli det syntetiserte svaret selv. Implikasjonene er dyptgripende for enhver virksomhet som har investert i tradisjonell sokemarkedsforing.

Med AI-henvist trafikk som vokser med hele 527% ar-over-ar, representerer de syv hovedpoengene som folger de nye lovene for overlevelse i en AI-forst, zero-click-verden. Hver enkelt er stottet av data, og sammen danner de en omfattende handlingsplan for a tilpasse din digitale strategi til realitetene i 2026.

Den kritiske forskjellen mellom SEO og GEO ligger i hva hvert system belonner. SEO belonner sider som tiltrekker menneskelige klikk gjennom overbevisende titler og metabeskrivelser. GEO belonner sider som AI-systemer stoler nok på til a sitere som autoritative kilder. Dette er fundamentalt forskjellige optimaliseringsmal, og a behandle dem som det samme vil etterlate innholdet ditt strandet mellom to paradigmer.

1. “TLDR”-regelen: sitater vinnes i de første 200 ordene

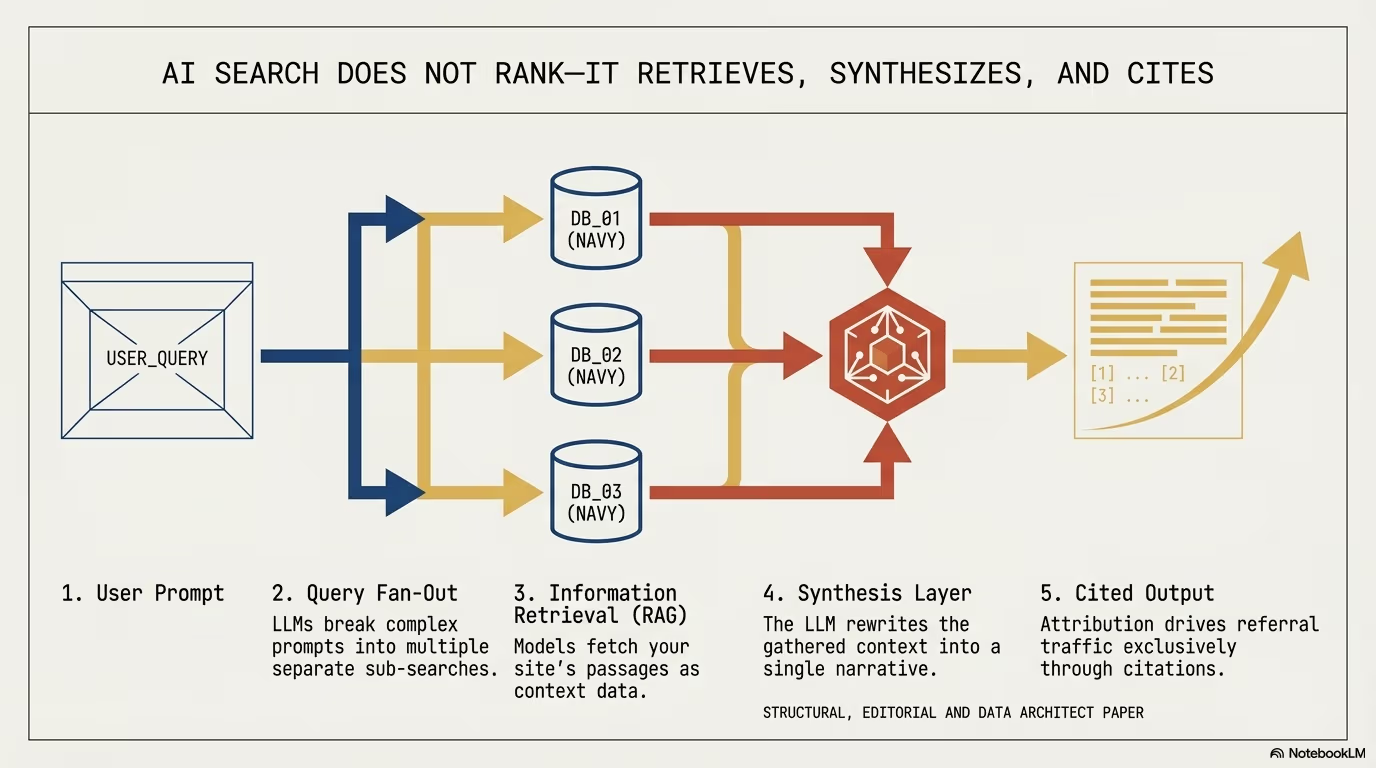

Dagene med a begrave hovedpoenget for a oppblase tid-på-side-metrikker er offisielt over. Moderne AI-hentesystemer bruker Retrieval-Augmented Generation (RAG), en prosess bygget for ekstrem effektivitet. Disse systemene leser ikke hele artikkelen din fra topp til bunn. De ekstraherer spesifikke passasjer for a mate modellkonteksten, og ekstraksjonsprosessen favoriserer sterkt innhold som vises tidlig i dokumentet.

Data viser at 44,2% av alle verifiserte LLM-sitater kommer fra de første 30% av en side. Denne statistikken alene bor omforme hvordan hvert innholdsteam tilnaermer seg artikkelstruktur. Hvis det direkte svaret ikke er i dine apningsavsnitt, eksisterer innholdet ditt praktisk talt ikke for maskinen.

For a vinne sitatet ma du ta i bruk en “svar-forst”-arkitektur: led med et konsist sammendrag på under 300 ord som direkte besvarer det primaere spørsmålet, deretter folg med datarik nyanse og stottende bevis. Tenk på det som a skrive et sammendrag for ledelsen som en maskin kan ekstrahere isolert og likevel levere et komplett, noyktig svar til brukeren.

Dette betyr ikke at innholdet ditt bor være grunt. Tvert imot. Dybden ma være der, men arkitekturen ma inverteres. Plasser dine mest siterverdige fakta, statistikker og deklarative utsagn i apningsseksjonen. Bruk deretter det resterende innholdet til a gi kontekst, bevis og nyanser som bygger autoritet.

“Svar på spørsmålet forst, forklar deretter nyansene. Slik bor du tilnaerme deg skriving for AI-søk generelt: klarhet forst, dybde deretter.”

Den praktiske implikasjonen er at hvert innholdsstykke trenger det man kan kalle et “siteringshode”: en tett, faktarik apningsseksjon spesielt designet for RAG-ekstraksjon. Denne seksjonen bor inneholde ditt primaere nøkkelord naturlig, et direkte svar på malsporrringen, og minst to stottende datapunkter. Alt som folger bygger på dette fundamentet.

2. 83%-sjokket: førsterangering garanterer ikke lenger AI-synlighet

En av de mest disruptive erkjennelsene for bedriftsledere er at tradisjonelle Google-rangeringer har frakoblet seg fra AI-sitater. Overlappet mellom toprangerte Google-lenker og kildene som siteres av AI-motorer har falt under 20%. Dette betyr at fire av fem AI-sitater kommer fra kilder som ikke ville dukket opp på en tradisjonell topp-ti-resultatside.

Enda mer sjokkerende indikerer forskning fra Digital Applied at 83% av AI Overview-sitater kommer fra sider som rangerer utenfor den organiske topp 10. Denne statistikken knuser antakelsen om at god SEO automatisk oversettes til AI-synlighet. De to systemene evaluerer innhold gjennom fundamentalt forskjellige linser.

AI-modeller prioriterer maskinekstraherbare fakta og strukturell klarhet over de tilbakekoblingstunge signalene i klassisk SEO. Der Googles algoritme vekter domeneautoritet, lenkekapital og brukerengasjementmetrikker, evaluerer AI-systemer hvor enkelt de kan ekstrahere et verifiserbart faktum, hvor tydelig innholdet er strukturert, og hvor sikre de kan være på informasjonens noyktigheyt.

Denne frakoblingen betyr at ditt “SEO-perfekte” nettsted kan være usynlig for de AI-modellene som na handterer kundenes spørsmål. Det betyr ogsa mulighet: et mindre nettsted med eksepsjonell innholdsstruktur, tydelige faktautsagn og sterk entitetsmarkering kan utkonkurrere en domeneautoritetsgigant i AI-sitater.

Det praktiske hovedpoenget er at virksomheter trenger parallelle optimaliseringsstrategier. Din SEO-innsats bor fortsette, men du ma legge GEO-spesifikke optimaliseringer på toppen: strukturert datamarkering, tydelige faktautsagn i de første 200 ordene, entitetsniva-skjemaimplementering og regelmessige innholdsfreskhetoppdateringer. A kjore SEO uten GEO i 2026 er som a optimalisere for desktop i 2015 mens du ignorerer mobil.

3. Autoritet er et nett, ikke en side (3,2x-multiplikatoren)

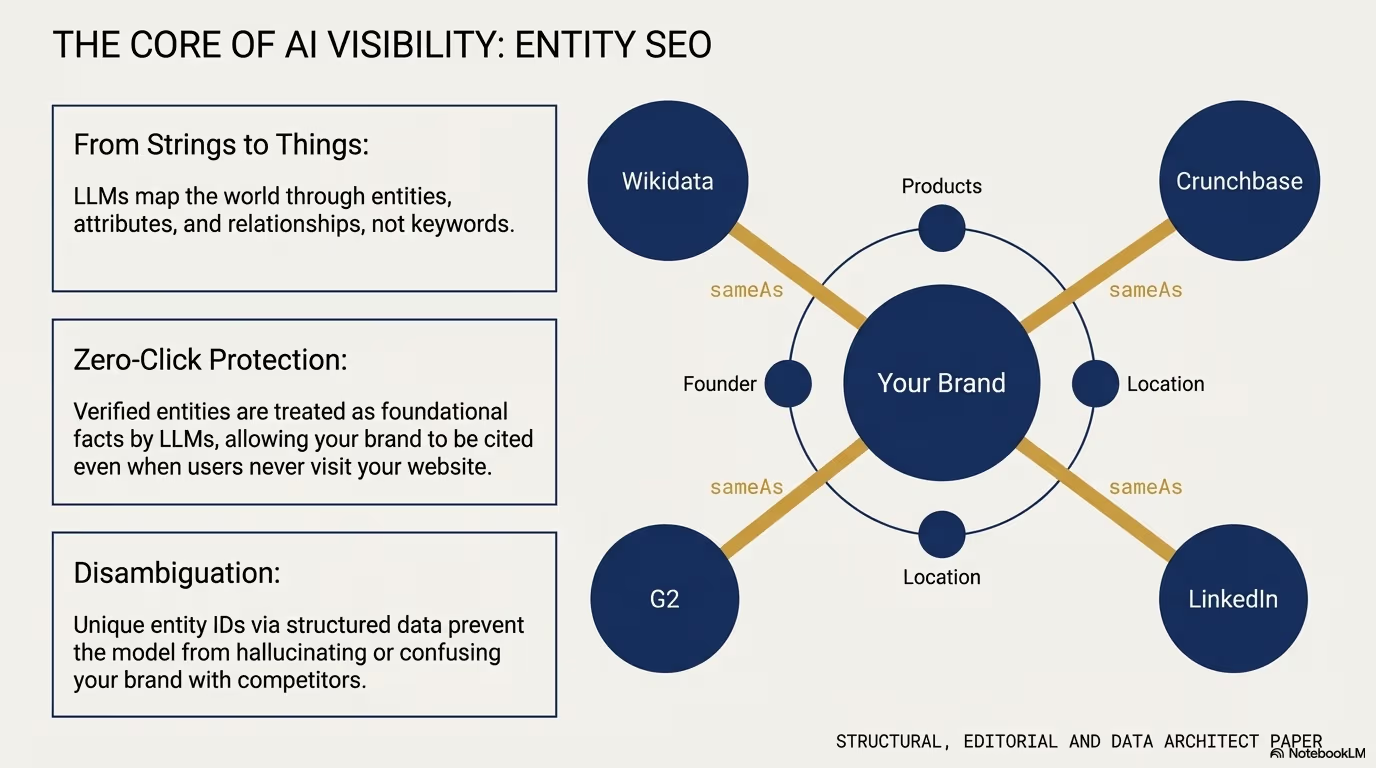

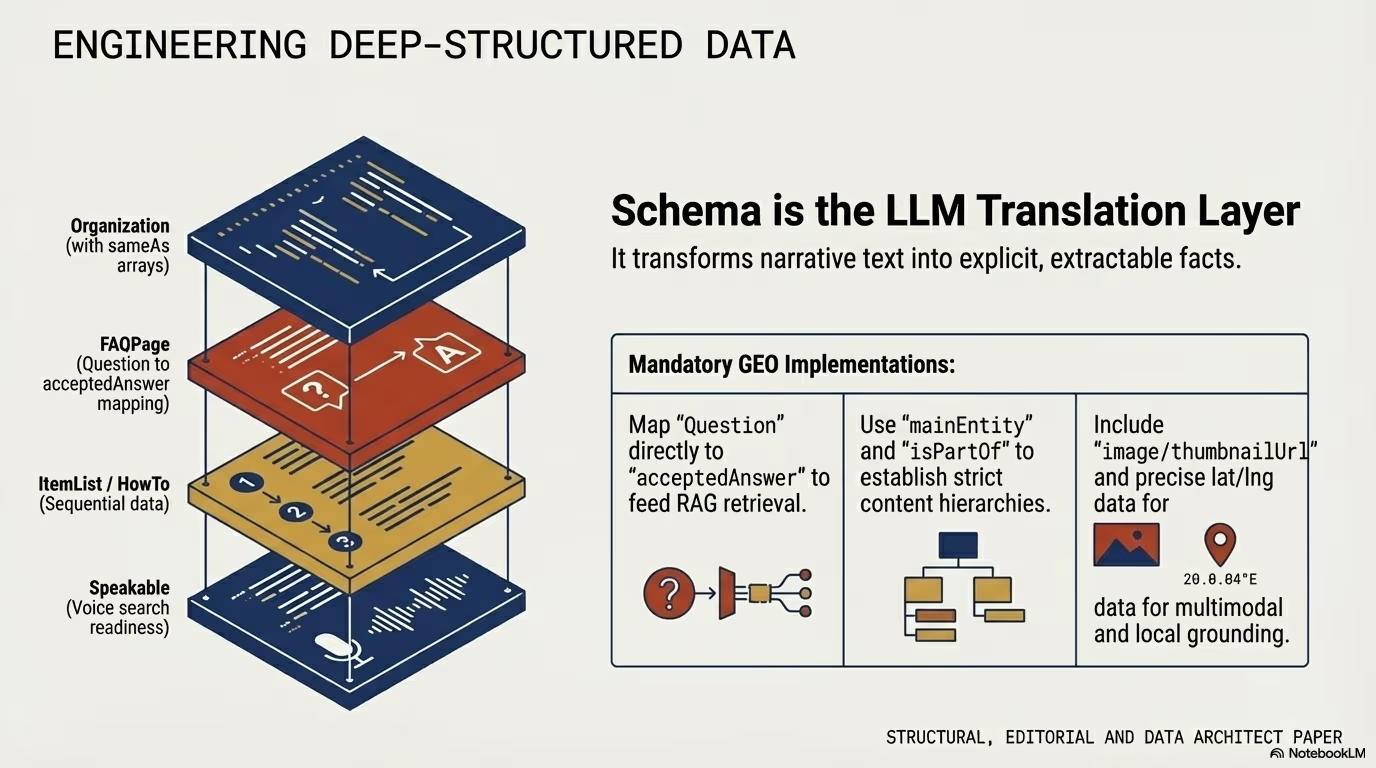

AI-motorer leter ikke bare etter en god side. De verifiserer en tematisk grafautoritet. Skiftet til en entity-first-arkitektur er na det strukturelle fundamentet for GEO, og dataene som stotter dette er overbevisende.

Analyse av millioner av AI-sitater bekrefter at 86% av sitatene kommer fra nettsteder med fem eller flere sammenkoblede sider om et spesifikt emne. Isolerte sider, uansett hvor godt skrevet de er, oppnar sjelden AI-sitater fordi den generative modellen ikke kan verifisere kildens bredere autoritet.

Bruk av en pilar-klynge-arkitektur gir en 3,2x økning i siteringsrater. AI-systemer trenger a se et tett nettverk av toveis interne lenker for a fole seg trygge nok til a sitere merkevaren din som en definitiv autoritet. Uten dette kontekstnettet forblir individuelle sider foreldrelose og upalitelige for generative modeller.

Hvordan ser dette ut i praksis? Det betyr a bygge innholdssystemer, ikke enkelstaende artikler. En pillarside dekker det brede temaet helhetlig, og klyngesider dykker dypt ned i deltemaer mens de lenker tilbake til pillaren og til hverandre. Den interne lenkestrukturen skaper et semantisk nett som AI kan traversere for a verifisere autoritet.

For eksempel bor et nettsted som dekker “WordPress-sikkerhet” som pillar ha sammenkoblede klyngesider om brannmurkonfigurasjon, oppdagelse av skadelig programvare, innloggingsherding, SSL-implementering, sikkerhetsskanning av utvidelser og hendelsesrespons. Hver side lenker til de andre med beskrivende ankertekst, noe som skaper en tett kunnskapsgraf som AI-systemer kan navigere og stole på.

Entity-first-tilnærmingen går lenger. Hvert nokkelbegrep på nettstedet ditt bor kobles til sin tilsvarende Wikidata-entitet, og dine strukturerte data bor uttrykke entitetsrelasjoner tydelig. Når et AI-system kan spore en klar entitetsgraf på tvers av innholdet ditt, behandler det nettstedet ditt som en kunnskapsbase i stedet for en samling urelaterte artikler.

4. 90-dagers ferskhets-klippet

I AI-eraen har innhold kortere holdbarhet enn noensinne. AI-systemer viser en massiv aktualitetsskjevhet og prioriterer oppdatert informasjon for a unnga hallusinasjoner eller utdaterte rad. Dataene om dette er tydelige og krever oppmerksomhet fra enhver innholdsstrateg.

Innhold oppdatert innen 90 dager oppnar 2x høyere siteringsrater sammenlignet med eldre materiale. Dette er ikke en marginal forbedring. Det er et binaert skille mellom innhold som blir sitert og innhold som blir ignorert.

Motsatt ignoreres innhold som ikke har blitt oppdatert på over 18 maneder i stor grad av generative motorer, uavhengig av historisk autoritet. En side som en gang tjente tusenvis av tilbakekoblinger og rangerte som nummer en i årevis, kan bli usynlig for AI-systemer rett og slett fordi den ikke har blitt oppdatert med ferske data og verifiserte fakta.

Den statiske “publiser og glem”-modellen har blitt erstattet av en obligatorisk kvartalsvis oppdateringssyklus. Hvis dataene dine ikke er ferske, finner AI-en ganske enkelt en konkurrent med ferskere data. Dette representerer et fundamentalt skifte i innholdsokonomi: kostnaden ved a vedlikeholde innhold er na like viktig som kostnaden ved a skape det.

Praktiske steg for a opprettholde ferskhet inkluderer a oppdatere statistikk og datapunkter kvartalsvis, legge til nye seksjoner som adresserer fremvoksende deltemaer, oppdatere publiserings- og sist-endret-datoer med genuine innholdsendringer, verifisere at alle eksterne lenker fremdeles fungerer og peker til gjeldende ressurser, og revidere eventuelle anbefalinger eller beste praksiser som kan ha endret seg siden siste oppdatering.

Ferskhetssignalet handler ikke bare om a endre en dato. AI-systemer er sofistikerte nok til a oppdage substansielle oppdateringer kontra kosmetiske endringer. En genuin oppdatering legger til ny informasjon, oppdaterer utdatert statistikk og gjenspeiler den navaerende tilstanden til temaet.

5. AI-systemer foretrekker “legitimitetslaget” (earned media-skjevheten)

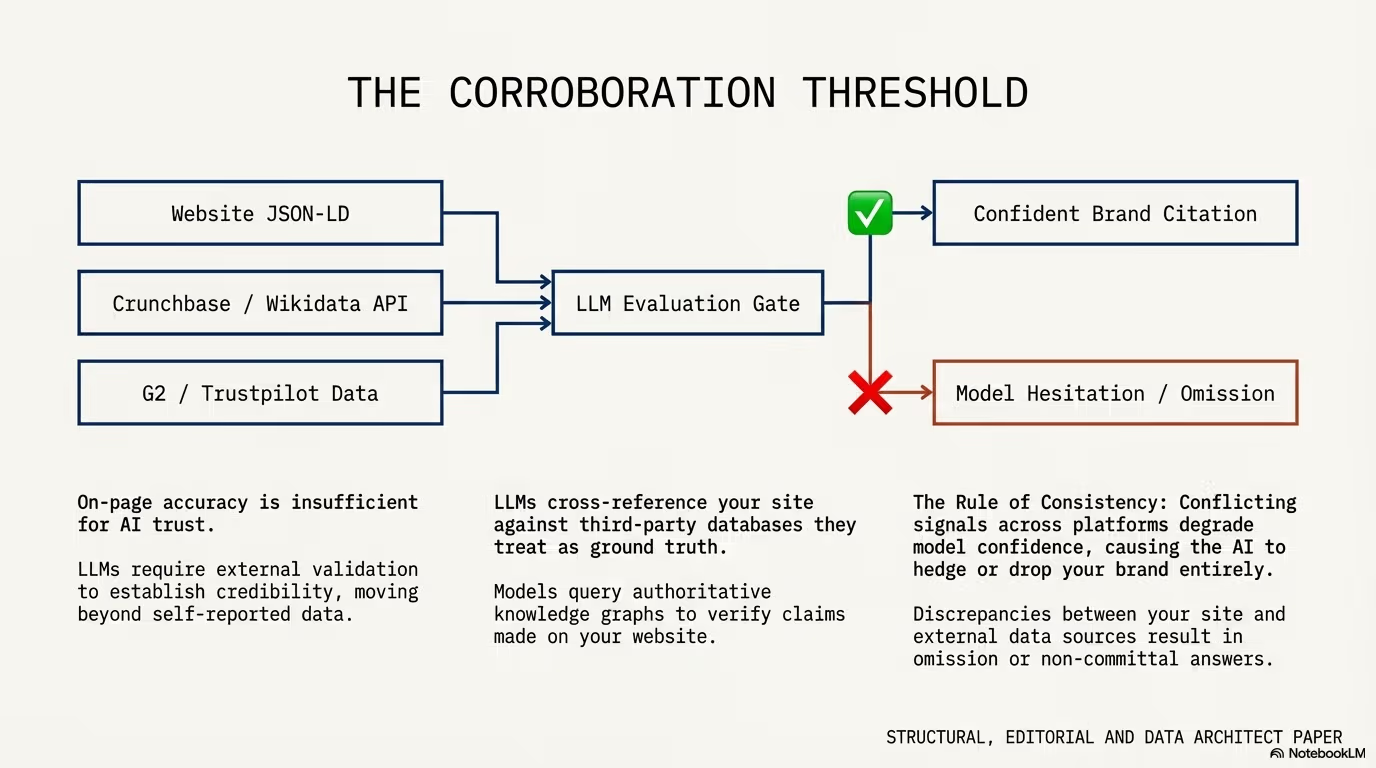

AI-sokemotorer viser en systematisk og overveldende skjevhet mot earned media: tredjepartsomtaler på autoritative plattformer, ikke merkeeget innhold. Dette er legitimitetslaget, og a forsta det er avgjorende for enhver GEO-strategi.

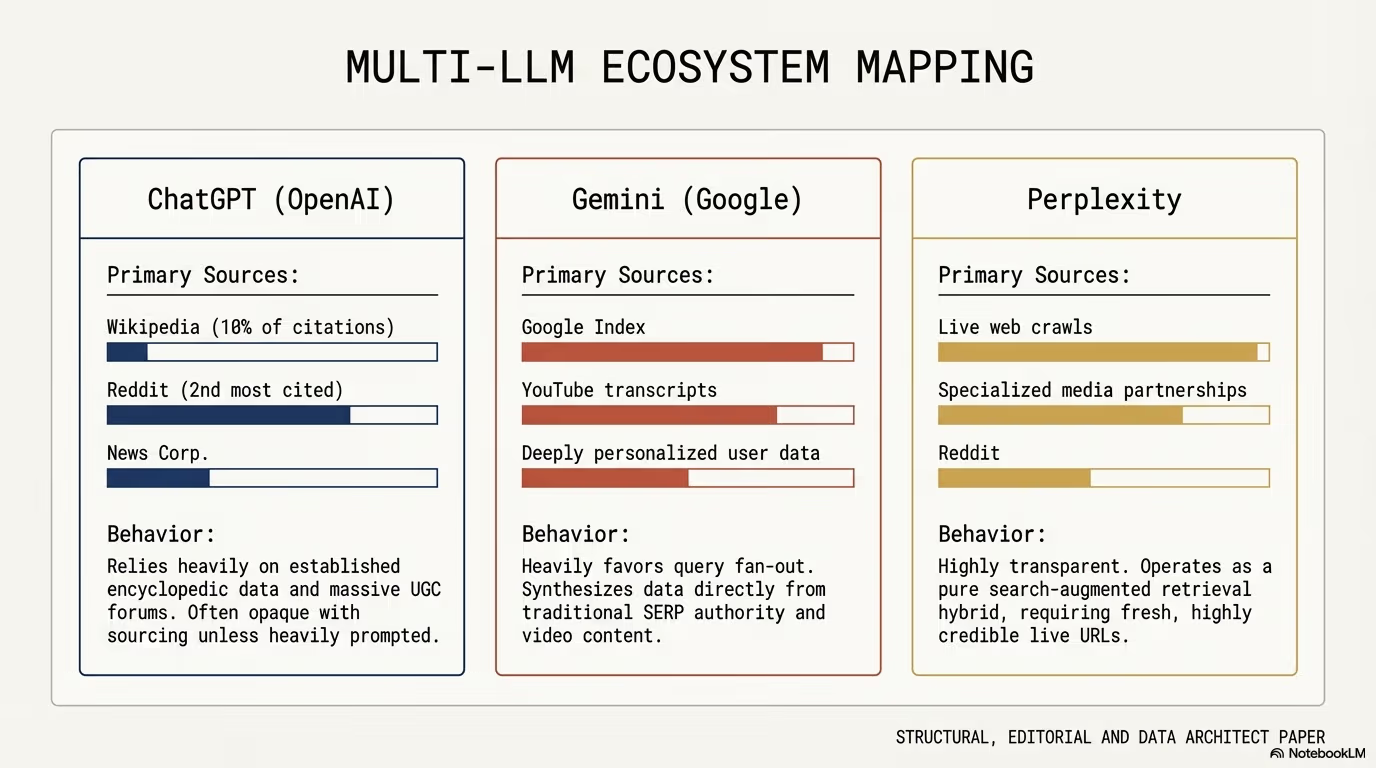

For eksempel forblir Wikipedia en dominerende kraft i AI-oppdagelse og står for 7,8% av alle ChatGPT-sitater. Denne ene plattformen genererer flere AI-sitater enn de fleste hele bedriftsnettsteder til sammen. Den nest mest siterte kilden, Reddit, ligger bak men representerer fremdeles en massiv andel av AI-referert innhold.

For a bli sitert av AI på ditt eget nettsted ma du ofte forst tjene omtaler på andre nettsteder som AI-en allerede stoler på, som Reddit, YouTube, store nyhetsmedier, bransjeblader og akademiske repositorier. Dette skaper en “zero-click-vollgrav” der din tilstedevaerelse på autoritative tredjepartsdomener fungerer som tillitstegnet som kreves for at en AI til slutt skal rettferdiggjore a sitere ditt primaerdomene.

Mekanismen fungerer slik: når en AI-modell moter merkevaren din omtalt positivt på Wikipedia, Reddit og bransjepublikasjoner, bygger den en intern tillitsscore for domenet ditt. Når den tillitsgrensen er passert, blir modellen villig til a sitere innhold direkte fra nettstedet ditt. Uten det tredjepartsvalideringslaget eksisterer førstepartsinnholdet ditt i et tillitsvakuum.

“Wikipedia leder ChatGPTs sitater med en andel på 7,8%, mens den nest mest siterte kilden, Reddit, ligger langt bak… det fungerer som et ‘legitimitetslag’ for selskaper.”

Dette betyr at digital PR, samfunnsengasjement og tankelederskap på tredjepartsplattformer ikke lenger er “hyggelig a ha”-merkevarektiviteter. De er strukturelle krav for AI-synlighet. Hver omtale på en autoritativ plattform oker sannsynligheten for at AI-systemer vil stole på og sitere innholdet på ditt primaerdomene.

Strategien krever talmodighet. A bygge legitimitetslaget er en langsiktig investering, men den sammensatte avkastningen i AI-synlighet gjor det til en av de høyeste ROI-aktivitetene innen digital markedsforing i dag.

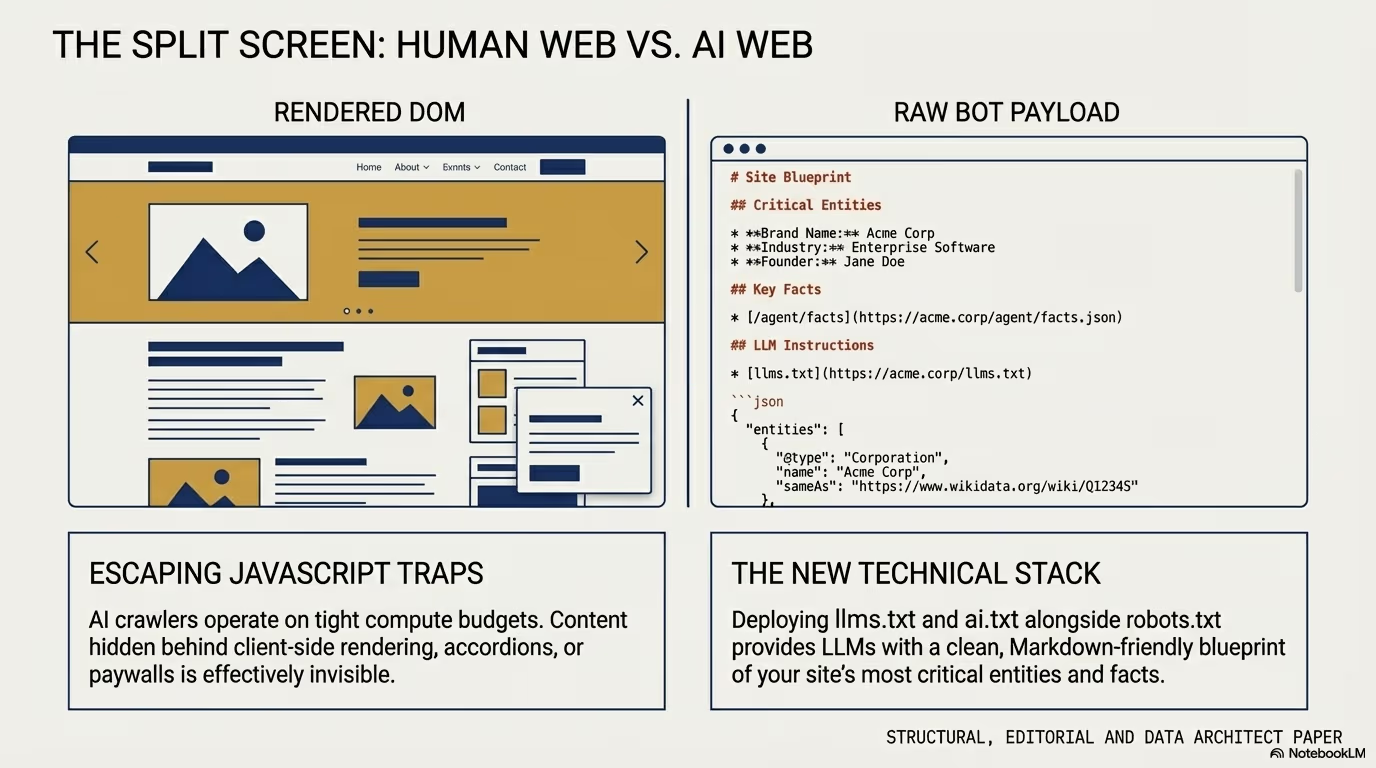

6. /llms.txt: “hemmelig handtrykk”

Etter hvert som nettsteder utvikler seg til a betjene både mennesker og maskiner, har en ny teknisk standard dukket opp: /llms.txt-filen. Mens robots.txt forteller crawlere hvor de kan gå, gir /llms.txt en kuratert, Markdown-formatert katalog spesielt for inferenstidsbruk av LLM-er. Dette er et fundamentalt annerledes formal: ikke a kontrollere tilgang, men aktivt a mate strukturert informasjon til AI-systemer når de trenger det mest.

Denne filen loser “kontekstvindu”-problemet. AI-boter sliter ofte med a analysere kompleks HTML, navigasjonsmenyer, JavaScript-generert innhold og flerlagede sidestrukturer. Når en AI-agent besoker nettstedet ditt under en aktiv samtale, har den et begrenset kontekstvindu og begrenset tid til a ekstrahere relevant informasjon. Et rent, maskinlesbart sammendrag loser dette problemet elegant.

Ved a tilby en strukturert /llms.txt-fil lar du AI-agenter ta inn ekspertinformasjonen din oyeblikkelig under en brukersamtale. Filen inneholder vanligvis nettstedets kjerneekspertiseomrader, viktige faktapastander, primaere innholdskategorier og lenker til dine mest autoritative sider, alt formatert i ren Markdown som enhver LLM kan behandle uten analyseoverhead.

Dette hemmelige handtrykket blir like essensielt som sidekartet var for den forrige eraen. Fremtidsrettede nettsteder implementerer allerede komplementaere filer: /llms.txt for strukturerte innholdssammendrag, /ai-sitemap.xml for AI-spesifikk innholdsoppdagelse, og strukturerte JSON-strommer som /ai-training-data.json som gir maskinoptimalisert innhold til ethvert AI-system som ber om det.

Implementeringen er grei. Opprett en Markdown-fil på domeneroten som beskriver nettstedets ekspertise, lister opp ditt viktigste innhold med korte sammendrag, og gir tydelige faktautsagn som AI-modeller kan ekstrahere og sitere. Oppdater den når du publiserer betydelig nytt innhold. Tenk på det som nettstedets CV for AI-systemer: konsist, faktabasert og strukturert for maskinforbruk.

Nettsteder som implementerer denne standarden rapporterer malbart høyere AI-siteringsrater, særlig for spørsmål der flere kilder konkurrerer om det samme svaret. /llms.txt-filen gir innholdet ditt en strukturell fordel i ekstraksjonsprosessen.

7. Intensjon over presisjon: kraften i “query fan-out”

AI drives av naturlig sprakbehandling (NLP), som prioriterer intensjonsmatching over nokkelorddensitet. Maten brukere søker på har endret seg fundamentalt, og dataene illustrerer omfanget av dette skiftet.

Tradisjonelle skrevne søk er forkortede fragmenter med gjennomsnittlig 4 ord. En bruker kan skrive “beste WordPress sikkerhetsplugins 2026.” AI-sporringer er samtalebaserte og detaljerte, med gjennomsnittlig 23 ord. Den samme brukeren forteller en AI: “Jeg driver en WooCommerce-butikk på delt hosting og er bekymret for sikkerheten. Hvilke utvidelser bor jeg installere for a beskytte mot de vanligste angrepene uten a senke nettstedet mitt?”

Brukere gir na full situasjonell kontekst i sine prompt. De beskriver sin spesifikke situasjon, begrensninger, preferanser og mål. Som svar utforer AI-motorer “query fan-out” og bryter ett komplekst spørsmål ned i flere delsporrringer for a finne det beste svaret. Det ene 23-ords spørsmålet kan generere fem eller seks interne delsporrringer, som hver søker etter forskjellige aspekter av svaret.

Innhold som hores robotisk ut eller er nokkelordstappet, straffes i denne prosessen. A skrive som en ekte person til en ekte person er na en teknisk optimalisering, ikke bare en stilistisk preferanse. Det sikrer at innholdet ditt samsvarer med den semantiske intensjonen AI-en prover a tilfredsstille under sin fan-out-prosess.

Den praktiske implikasjonen er betydelig. I stedet for a optimalisere for korte nokkelfraseer, bor du optimalisere for situasjonene og kontekstene som brukere beskriver i sine AI-samtaler. Dette betyr a skrive innhold som adresserer spesifikke scenarioer, anerkjenner begrensninger og gir nyanserte anbefalinger i stedet for generiske rad.

Innhold strukturert rundt “Hvis du er i situasjon X, er den beste tilnærmingen Y fordi Z” presterer langt bedre i AI-sitering enn innhold strukturert rundt “Den beste tilnærmingen er Y.” Den situasjonelle konteksten gir AI-en tillit til at svaret ditt gjelder for det spesifikke brukersporsalet den behandler.

Dette betyr ogsa at langhale, spørsmålbasert innhold er mer verdifullt enn noensinne. FAQ-seksjoner, detaljerte steg-for-steg-guider og scenariospesifikke anbefalinger gir AI-systemer nettopp det strukturerte, situasjonsbevisste innholdet de trenger for a generere noyktige, siterte svar.

Bli svaret

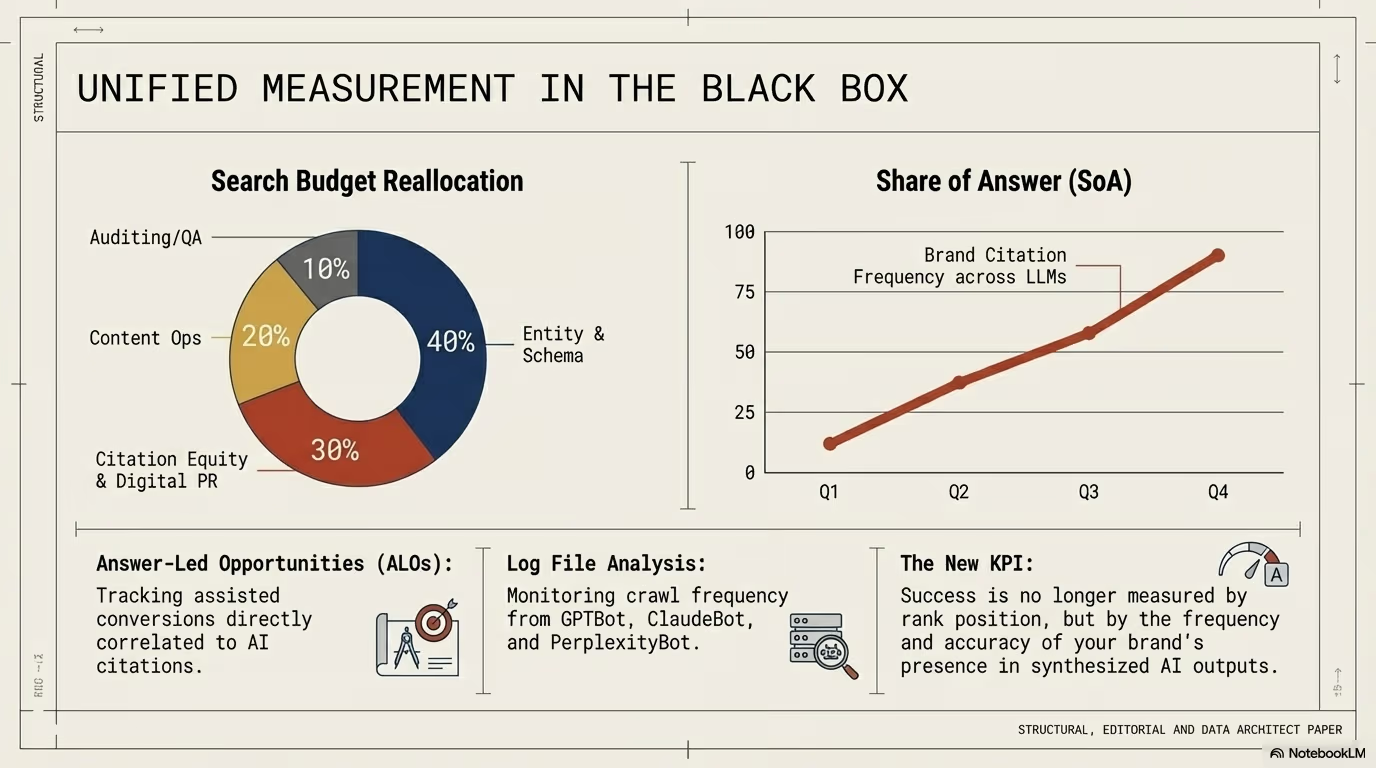

I 2026 handler synlighet ikke lenger om a være en av ti lenker på en side. Det handler om a være det definitive svaret på tvers av et fragmentert landskap av LLM-er. Enten det er ChatGPT, Gemini eller Perplexity, søker disse systemene etter strukturert, ferskt og autoritativt innhold de kan rettferdiggjore overfor brukerne sine.

Overgangen til GEO krever et skifte fra a jakte på klikk til a eie sitatet. Dette er ikke bare en taktisk justering. Det er en strategisk reorientering som påvirker innholdsproduksjon, teknisk infrastruktur, digital PR og ytelsesmaling.

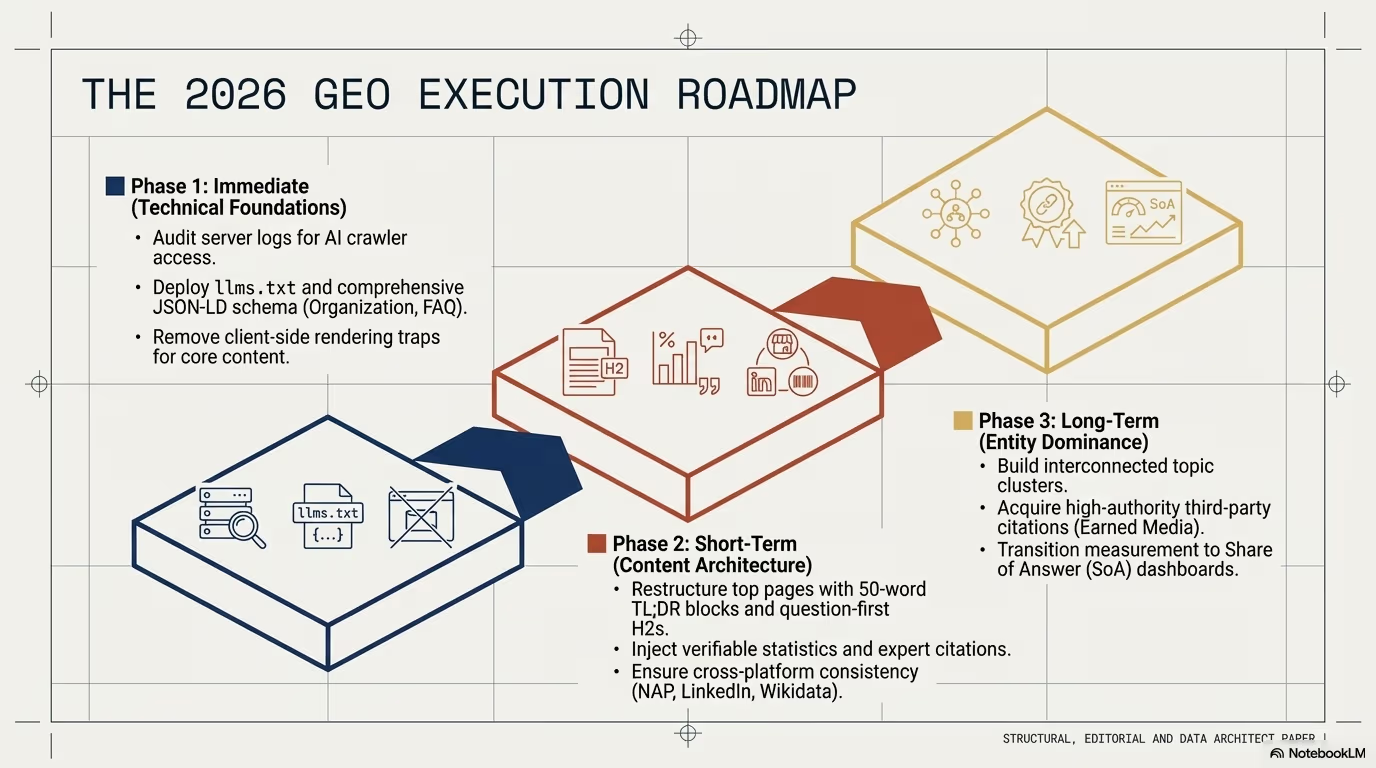

De syv sannhetene skissert i denne artikkelen danner et handlingsrettet rammeverk:

- Strukturer innhold for ekstraksjon: Plasser dine mest siterverdige fakta i de første 200 ordene og bygg en svar-forst-arkitektur som RAG-systemer effektivt kan behandle.

- Frakobel strategiene dine: Erkjenn at SEO og GEO er parallelle men distinkte optimaliseringsmal, og invester i begge.

- Bygg tematiske autoritetsnettverk: Skap sammenkoblede innholdssystemer med fem eller flere sider per temaklynge, forbundet med toveis interne lenker og entitetsmarkering.

- Oppretthold en 90-dagers oppdateringssyklus: Behandle hvert innholdsstykke som et levende dokument som krever kvartalsvise oppdateringer med genuin ny informasjon og verifiserte data.

- Invester i legitimitetslaget: Bygg tilstedevaerelse på autoritative tredjepartsplattformer som AI-systemer allerede stoler på, for a skape tillitssignalene som trengs for direkte sitering.

- Implementer /llms.txt-standarden: Gi AI-systemer et rent, strukturert inngangspunkt til din ekspertise ved a tilby maskinoptimaliserte innholdssammendrag.

- Skriv for intensjon, ikke nøkkelord: Skap situasjonsbevisst innhold som matcher de samtalebaserte, kontekstuelle sporrringene brukere bringer til AI-systemer.

Etter hvert som vi beveger oss dypere inn i denne AI-forst-eraen, ma bedriftsledere konfrontere en ny virkelighet av maling og verdi. Hvis en bruker aldri klikker seg gjennom til nettstedet ditt, men får merkevarens svar fra en AI, vant du da likevel, og hvordan skal du male det?

Virksomhetene som svarer på dette spørsmålet forst, vil definere det neste tiaret med digital strategi. Nye metrikker er i ferd med a vokse fram: siteringsfrekvens på tvers av AI-plattformer, merkevareomtalesentiment i AI-genererte svar, entitetstillitsscorer og svareierskap for nokkelsporringer. Disse metrikkene vil til slutt bli like standard som organisk trafikk og konverteringsrater er i dag.

Slutten på klikket er ikke slutten på synlighet. Det er begynnelsen på en ny type innflytelse, en der det a være den palitelige kilden som AI siterer er mer verdifullt enn a være lenken en bruker klikker på. Organisasjonene som forstår dette skiftet og handler na, vil eie den mest verdifulle eiendommen i den digitale okonomien: selve svaret.