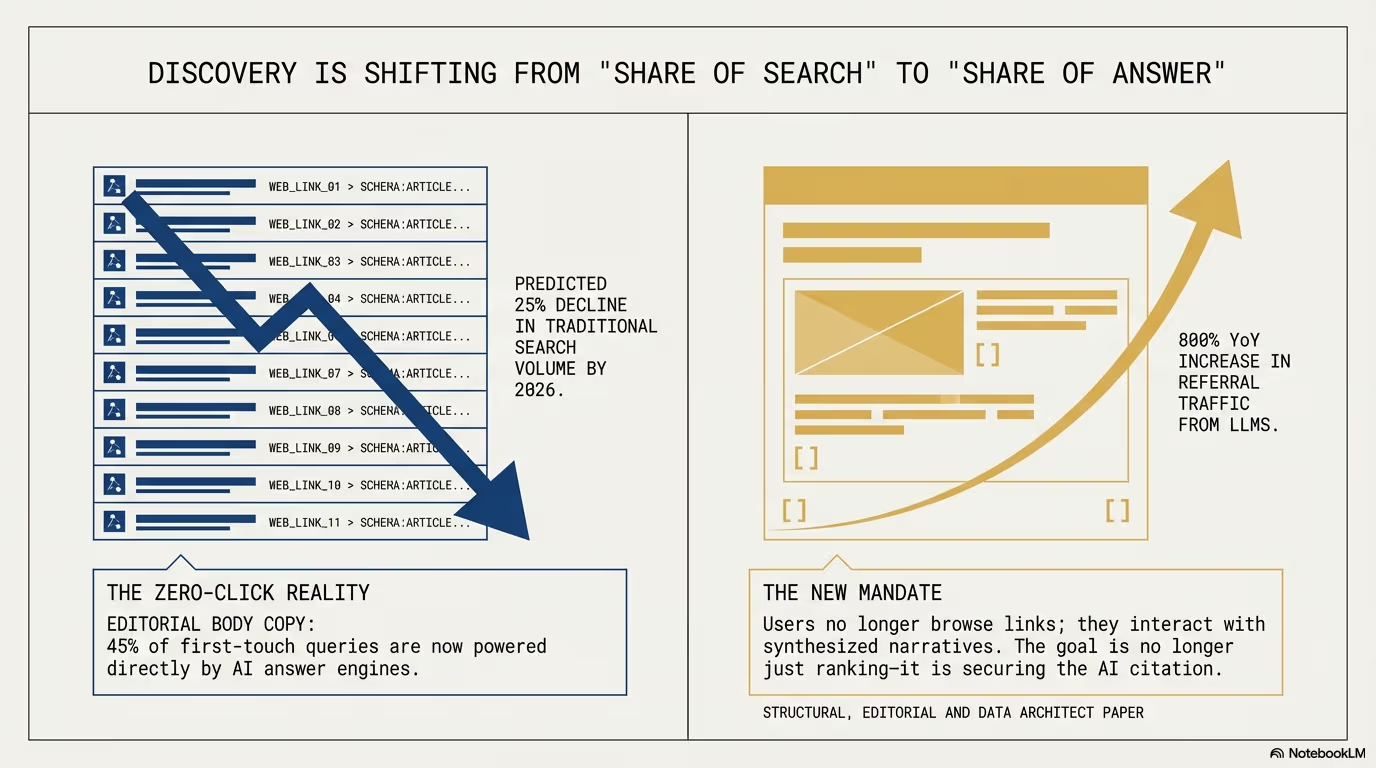

W 2026 roku wyszukiwanie AI zastąpiło niebieski link jako główna bramę do informacji. Gartner prognozował 25% spadek tradycyjnego wolumenu wyszukiwań, a przy ruchu z AI rosnącym o 527% rok do roku, te 7 prawd definiuje przetrwanie w erze zero-click. Zrozumienie tych zasad jest kluczowe dla każdej firmy, która polega na organicznej widoczności, ponieważ reguły odkrywalności zostały napisane od nowa.

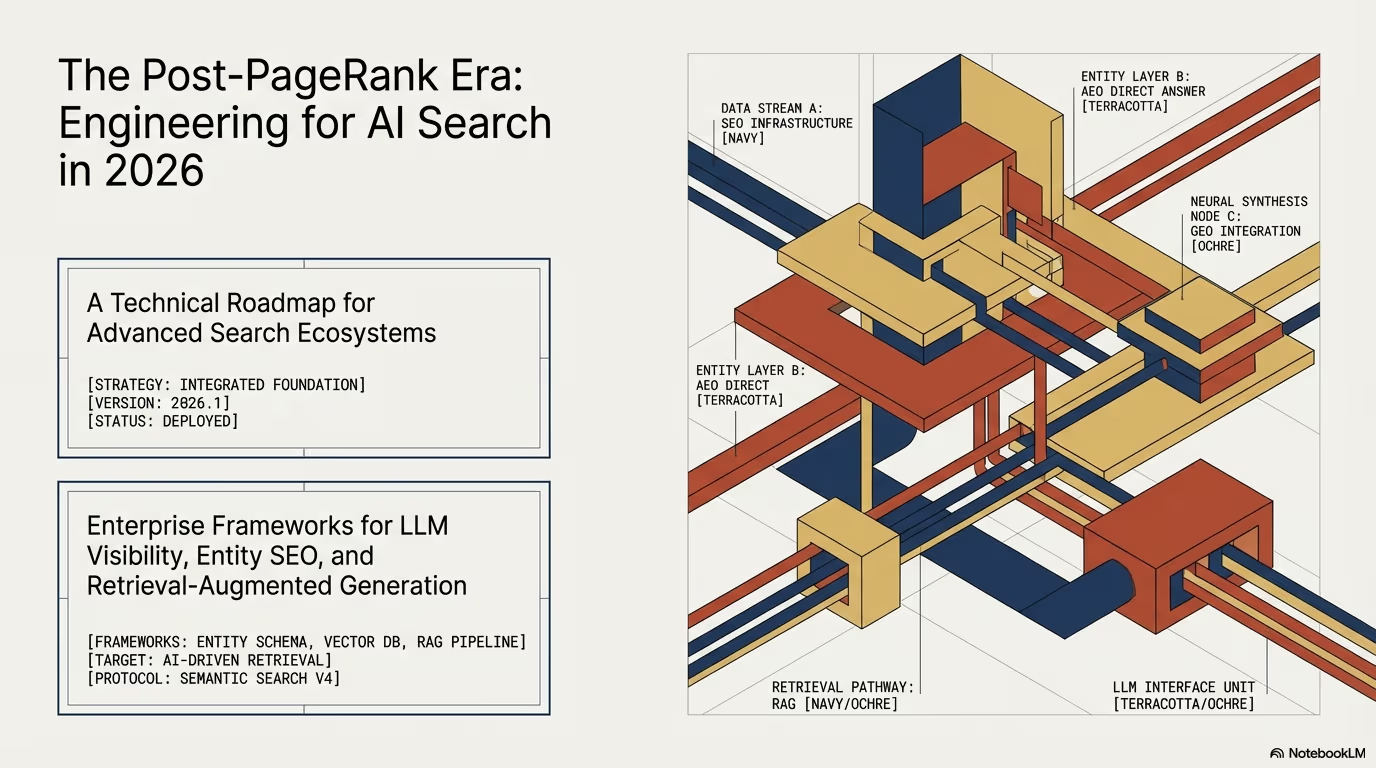

Przejście z SEO na GEO

Krajobraz cyfrowy przeszedł tektoniczny zwrot. Przez dziesięciolecia niebieski link był główna waluta internetu, ale ta era się skończyła. Przeszliśmy poza wyszukiwarkę i wkroczyliśmy w epokę silnika odpowiedzi. Prognoza Gartnera dotycząca 25% spadku tradycyjnego wolumenu wyszukiwań do 2026 roku w dużej mierze się zrealizowała, a dowody są wszędzie: użytkownicy nie przeszukują już dziesięciu niebieskich linków na stronie wyników. Prowadzą kontekstowe rozmowy z systemami AI, które syntezują informację i dostarczają odpowiedzi bezpośrednio.

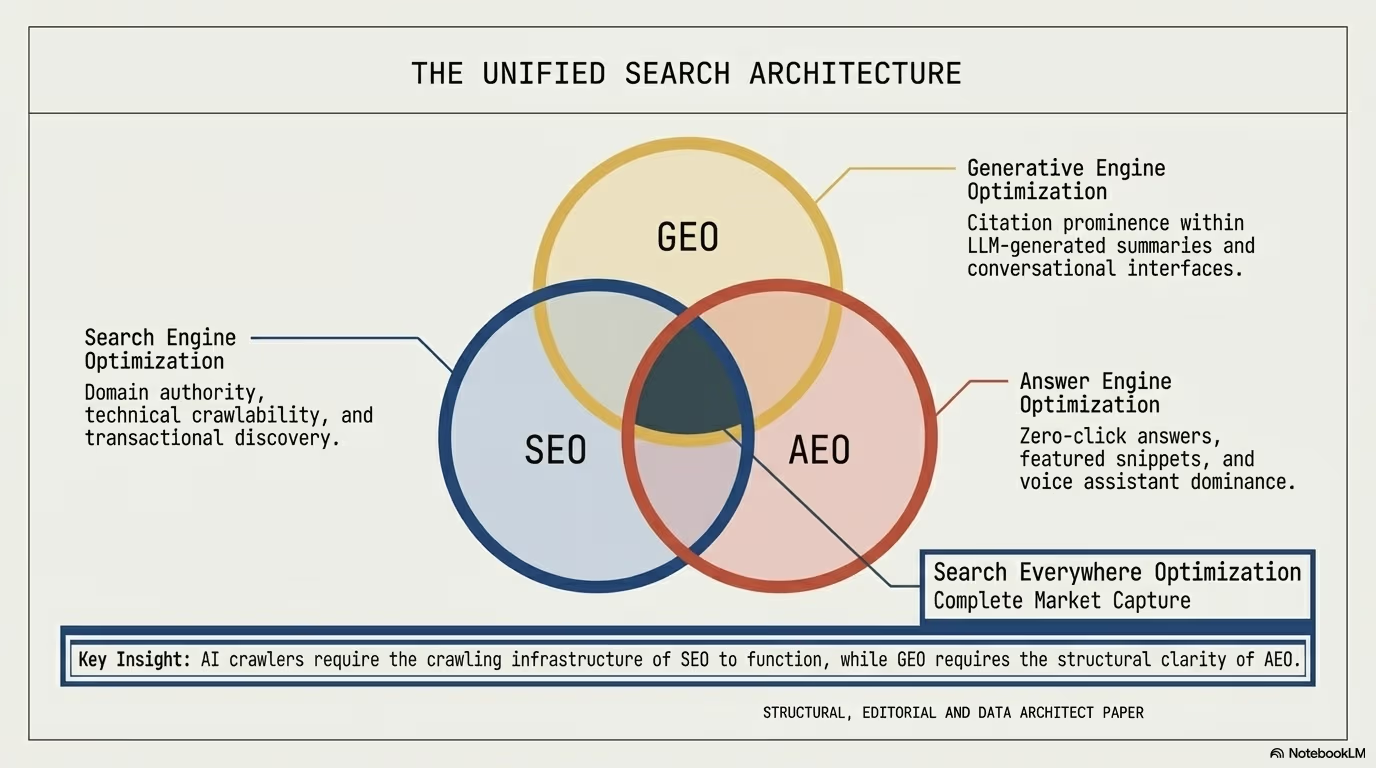

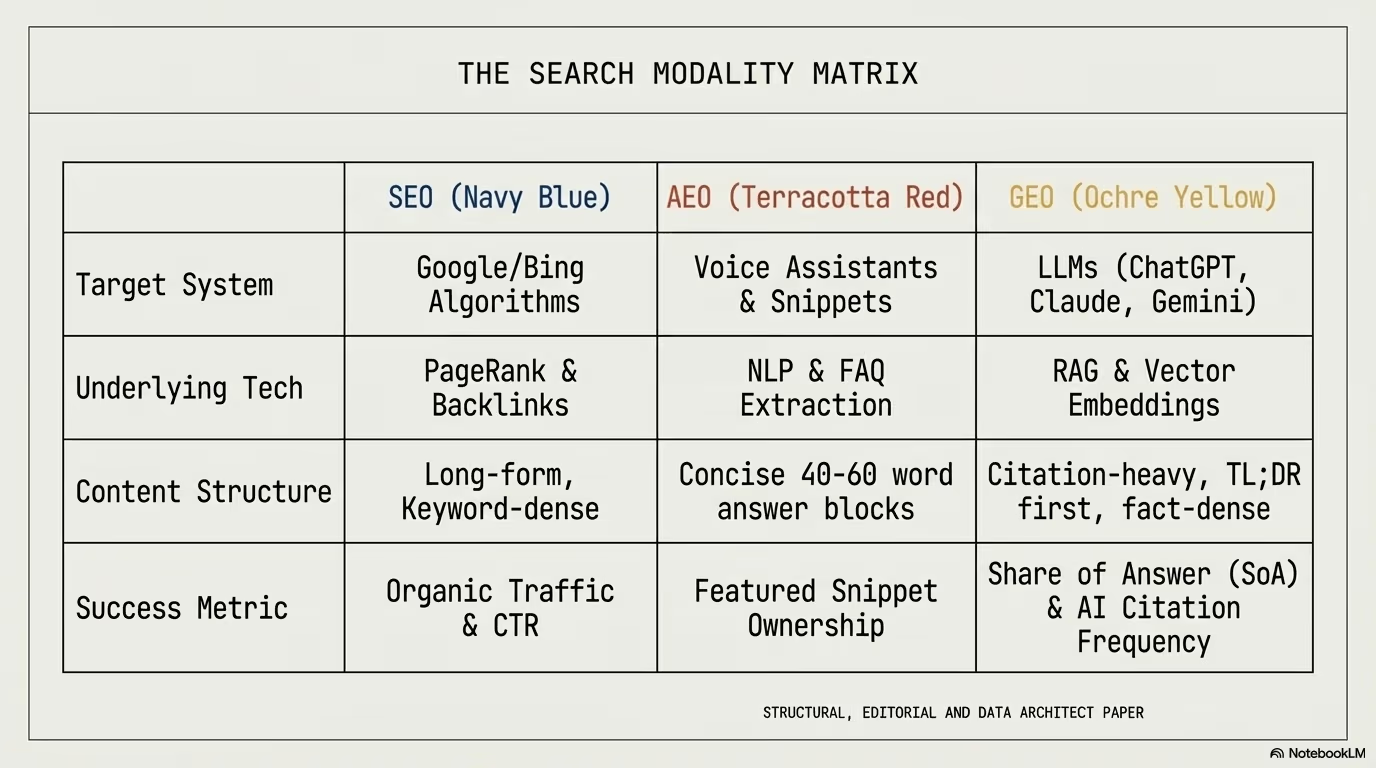

To przejście od Search Engine Optimization (SEO) do Generative Engine Optimization (GEO). W tym nowym paradygmacie widoczność nie polega na byciu numerem jeden na liście. Chodzi o stanie się syntezowana odpowiedzią. Implikacje są ogromne dla każdej firmy, która zainwestowała w tradycyjny marketing w wyszukiwarkach.

Przy ruchu z AI rosnącym o oszałamiające 527% rok do roku, siedem wniosków przedstawionych poniżej stanowi nowe prawa przetrwania w świecie AI-first i zero-click. Każdy z nich jest poparty danymi, a razem tworzą kompleksowy podręcznik adaptacji strategii cyfrowej do realiów 2026 roku.

Kluczowa różnica między SEO a GEO leży w tym, co każdy z tych systemów nagradza. SEO nagradza strony, które przyciągają ludzkie kliknięcia poprzez przekonujące tytuły i opisy meta. GEO nagradza strony, którym systemy AI ufają na tyle, by cytować je jako autorytatywne źródła. To zasadniczo różne cele optymalizacji, a traktowanie ich jako tego samego sprawi, że twoje treści utkna między dwoma paradygmatami.

1. Zasada “TLDR”: cytaty wygrywa się w pierwszych 200 słowach

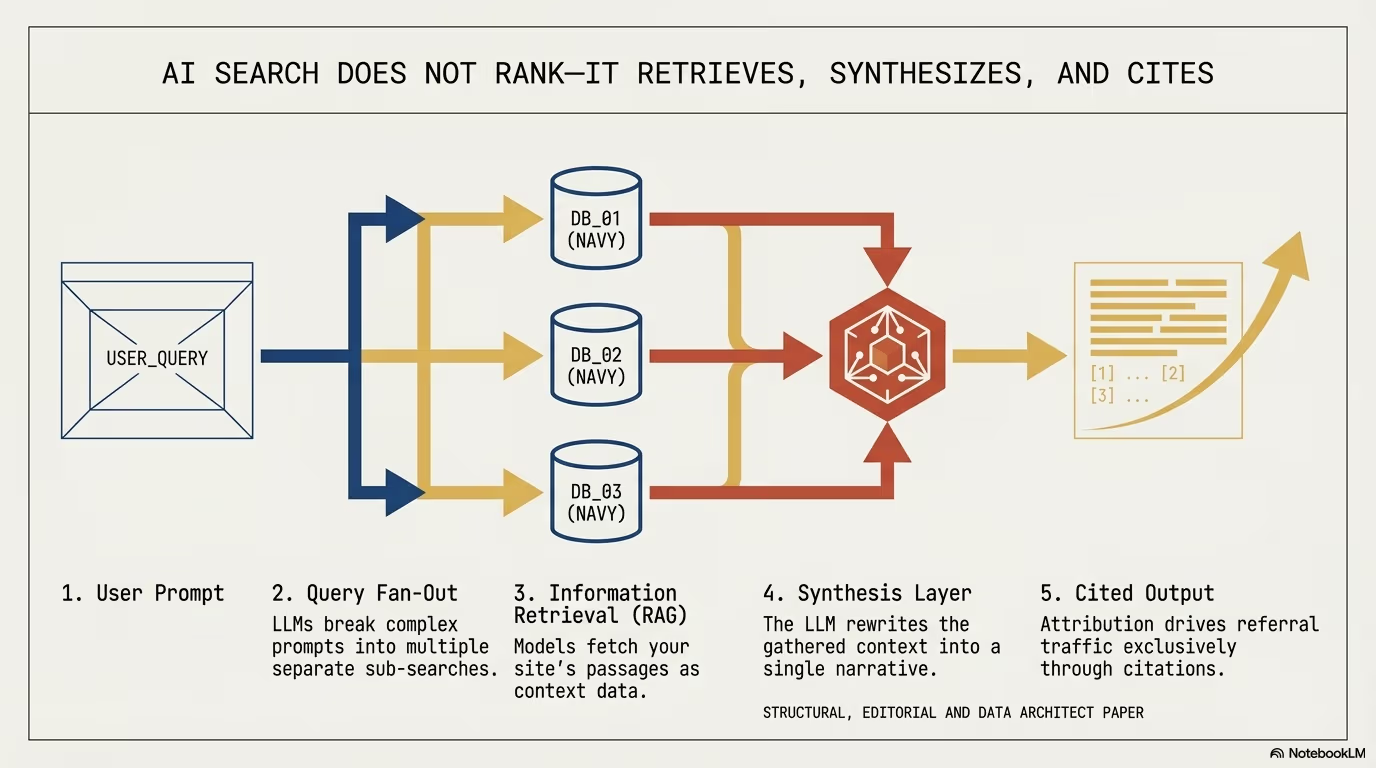

Czasy ukrywania sedna sprawy, aby zawyzyc metryki czasu na stronie, są oficjalnie przeszłością. Nowoczesne systemy wyszukiwania AI wykorzystują Retrieval-Augmented Generation (RAG), proces zbudowany z mysla o ekstremalnej efektywności. Systemy te nie czytają całego artykułu od gory do dolu. Wyodrębniają konkretne fragmenty, aby zasilic kontekst modelu, a proces ekstrakcji zdecydowanie faworyzuje treści pojawiajace się wczesnie w dokumencie.

Dane pokazują, że 44,2% wszystkich zweryfikowanych cytatów LLM pochodzi z pierwszych 30% strony. Sama ta statystyka powinna zmienic podejscie każdego zespołu contentowego do struktury artykułów. Jeśli bezpośrednia odpowiedz nie znajduje się w początkowych akapitach, twoja treść praktycznie nie istnieje dla maszyny.

Aby zdobyc cytat, musisz przyjac architekture “odpowiedz na początku”: zacznij od zwiezlego podsumowania poniżej 300 słów, które bezpośrednio odpowiada na główne zapytanie, a następnie rozwin temat o bogate w dane niuanse i materiały dowodowe. Potraktuj to jak pisanie streszczenia wykonawczego, które maszyna może wyekstrahowac w izolacji i nadal dostarczyc kompletna, dokladna odpowiedz użytkownikowi.

To nie oznacza, że twoje treści powinny być plytkie. Wrecz przeciwnie. Głębia musi być obecna, ale architektura musi zostac odwrocona. Umiesc najbardziej wartościowe dla cytowania fakty, statystyki i deklaratywne stwierdzenia w sekcji otwierajacej. Następnie wykorzystaj pozostala treść do dostarczenia kontekstu, dowodow i niuansow budujących autorytet.

“Najpierw odpowiedz na pytanie, potem wyjasniaj niuanse. Tak własnie należy podchodzic do pisania pod wyszukiwanie AI: jasność na pierwszym miejscu, glębia na drugim.”

Praktyczna implikacja jest taka, że każdy materiał potrzebuje czegos, co można nazwać “naglowkiem cytowania”: gestej, bogatej w fakty sekcji otwierajacej, zaprojektowanej specjalnie pod ekstrakcje RAG. Ta sekcja powinna zawierac twoje główne słowo kluczowe w naturalny sposob, bezpośrednia odpowiedz na docelowe zapytanie i co najmniej dwa punkty danych wspierajacych. Wszystko, co następuje, buduje na tym fundamencie.

2. Szok 83%: pozycja numer jeden nie gwarantuje już widoczności w AI

Jednym z najbardziej przełomowych odkryć dla liderów biznesu jest to, że tradycyjne rankingi Google oddzieliły się od cytowań AI. Pokrywanie się między najwyżej pozycjonowanymi linkami Google a źródłami cytowanymi przez silniki AI spadło poniżej 20%. Oznacza to, że cztery na pięć cytatów AI pochodzą ze źródeł, które nie pojawiłyby się na tradycyjnej stronie top 10 wyników.

Co bardziej szokujace, badania Digital Applied wskazują, że 83% cytatów AI Overview pochodzi że stron pozycjonujących się poza organicznym top 10. Ta statystyka obala założenie, że dobre SEO automatycznie przekklada się na widoczność w AI. Oba systemy oceniają treści przez zasadniczo różne soczewki.

Modele AI priorytetyzują fakty możliwe do wyekstrahowania przez maszyny i strukturalną jasność nad sygnałami opartymi na linkach zwrotnych klasycznego SEO. Tam, gdzie algorytm Google waży autorytet domeny, kapitał linków i metryki zaangażowania użytkowników, systemy AI oceniają, jak łatwo mogą wyekstrahować weryfikowalny fakt, jak jasno ustrukturyzowana jest treść i jak pewne mogą być co do dokładności informacji.

To rozdzielenie oznacza, że twoja “perfekcyjna pod SEO” strona może być niewidoczna dla modeli AI obsługujących zapytania twoich klientów. Oznacza to również szanse: mniejsza strona z wyjatkowa struktura treści, jasnymi stwierdzeniami faktycznymi i silnym znacznikowaniem encji może przewyższać giganta autorytetu domenowego w cytowaniach AI.

Praktyczny wniosek jest taki, że firmy potrzebują równoleglych strategii optymalizacji. Twoje działania SEO powinny być kontynuowane, ale musisz nalozyc na nie optymalizację specyficzne dla GEO: znaczniki danych strukturalnych, jasne stwierdzenia faktyczne w pierwszych 200 słowach, implementacje schematu na poziomie encji i regularne aktualizacje świeżości treści. Prowadzenie SEO bez GEO w 2026 roku jest jak optymalizacja pod desktop w 2015 roku z jednoczesnym ignorowaniem mobile.

3. Autorytet to siec, nie strona (mnoznik 3,2x)

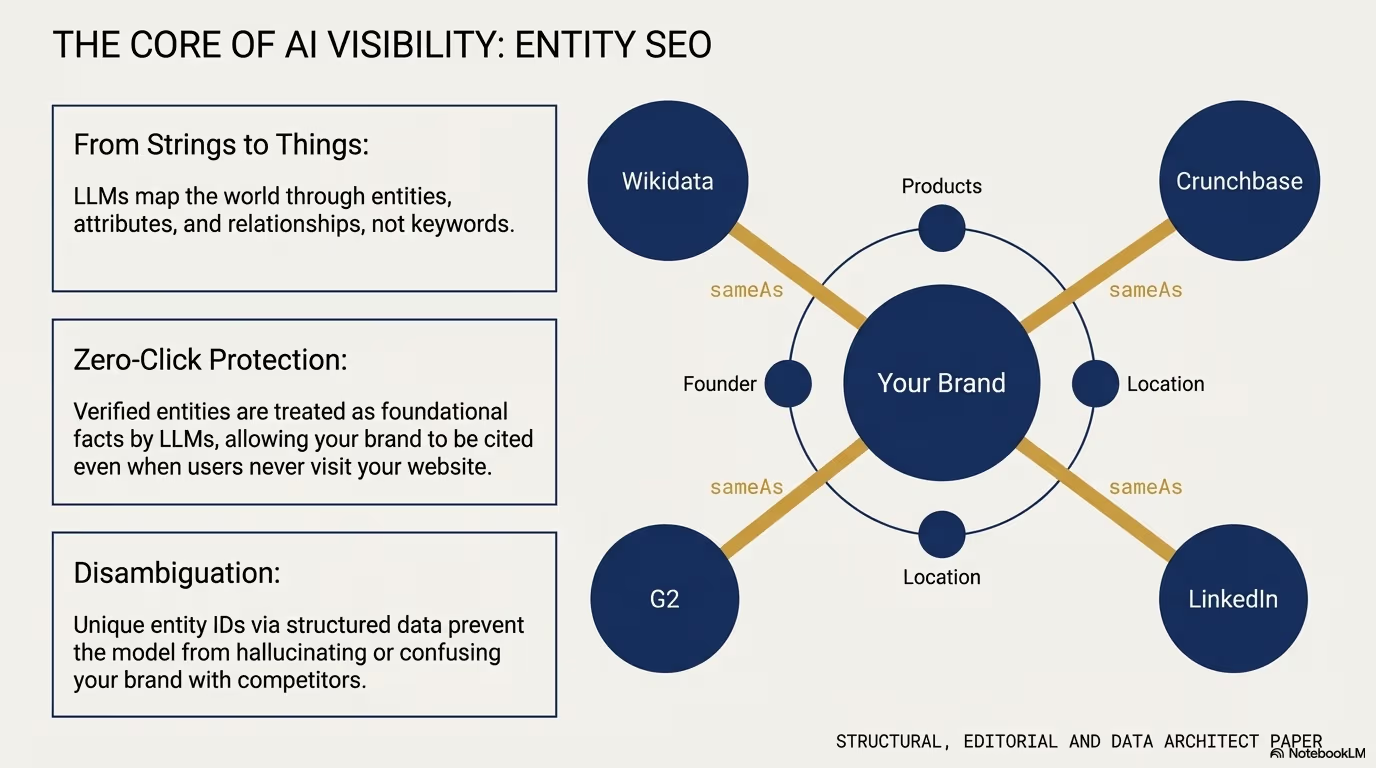

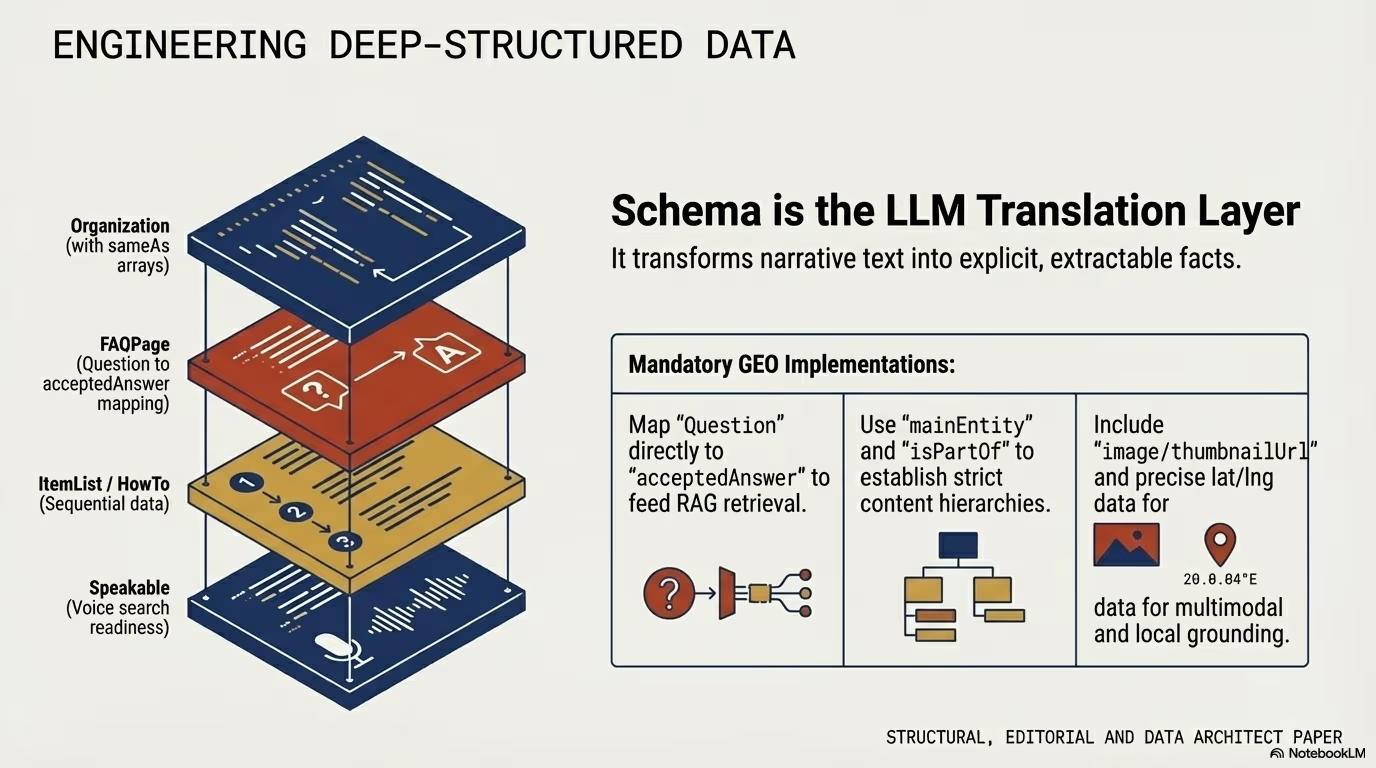

Silniki AI nie szukają po prostu dobrej strony. Weryfikują autorytet grafu tematycznego. Przejście na architekture entity-first jest teraz strukturalna podstawa GEO, a dane to potwierdzajace są przekonujące.

Analiza milionow cytatów AI potwierdza, że 86% cytatów pochodzi że stron z piecioma lub więcej połączonymi stronami na dany temat. Izolowane strony, niezależnie od tego, jak dobrze są napisane, rzadko zdobywają cytowania AI, ponieważ model generatywny nie może zweryfikować szerszego autorytetu źródła.

Zastosowanie architektury filar-klaster zapewnia 3,2-krotny wzrost wskaźników cytowan. Systemy AI potrzebują gestej sieci dwukierunkówych linków wewnętrznych, aby czuc się na tyle pewnie, by cytować twoja marke jako definitywny autorytet. Bez tej sieci kontekstu poszczegolne strony pozostają osierocone i niezaufane przez modele generatywne.

Jak to wyglada w praktyce? Oznacza budowanie ekosystemów treści, a nie samodzielnych artykułów. Strona filarowa obejmuje szeroki temat kompleksowo, a strony klastrowe zaglebają się w podtematy, linkując z powrotem do filara i do siebie nawzajem. Struktura linków wewnętrznych tworzy siec semantyczna, która AI może przejsc, aby zweryfikować autorytet.

Na przykład strona obejmujaca “bezpieczeństwo WordPressa” jako filar powinna mieć połączone strony klastrowe dotyczące konfiguracji firewalla, wykrywania malware, hartowania logowania, implementacji SSL, skanowania podatności wtyczek i reagowania na incydenty. Każda strona linkuje do pozostałych z opisowymi tekstami kotwic, tworząc gesty graf wiedzy, po którym systemy AI moga nawigować i któremu moga ufac.

Podejscie entity-first idzie dalej. Każda kluczowa koncepcja na twojej stronie powinna być połączona z odpowiadająca encja Wikidata, a twoje dane strukturalne powinny jasno wyrazac relacje między encjami. Gdy system AI może prośledzic czysty graf encji w twojej treści, traktuje twoja stronę jako baze wiedzy, a nie zbior niepowiazanych artykułów.

4. 90-dniowy klif świeżości

W erze AI treści maja krotsza date ważności niż kiedykolwiek. Systemy AI wykazują ogromne uprzedzenie na rzecz aktualności, priorytetyzując aktualne informację, aby uniknac halucynacji lub przestarzalych porad. Dane na ten temat są jednoznaczne i wymagają uwagi każdego stratega treści.

Treści aktualizowane w ciagu 90 dni osiagają 2x wyzszy wskaźnik cytowan w porównaniu że starszymi materiałami. To nie jest marginalna poprawa. To binarne rozroznienie między treścia, która jest cytowana, a treścia, która jest ignorowana.

Odwrotnie, treści które nie były aktualizowane przez ponad 18 miesięcy są w dużej mierze ignorowane przez silniki generatywne, niezależnie od ich historycznego autorytetu. Strona, która kiedys zdobyla tysiace linków zwrotnych i pozycjonowala się na pierwszym miejscu przez lata, może stac się niewidoczna dla systemów AI po prostu dlatego, że nie została odswiezone o aktualne dane i zweryfikowane fakty.

Statyczny model “publikuj i zapomnij” został zastąpiony obowiązkowym kwartalnym cyklem odświeżania. Jeśli twoje dane nie są świeże, AI po prostu znajdzie konkurenta, którego dane są. To fundamentalna zmiana w ekonomii treści: koszt utrzymania treści jest teraz rownie ważny jak koszt ich tworzenia.

Praktyczne kroki utrzymania świeżości obejmują kwartalne aktualizowanie statystyk i punktow danych, dodawanie nowych sekcji odnoszacych się do pojawiajacych się podtematow, odświeżanie dat publikacji i ostatniej modyfikacji z prawdziwymi zmianami treści, weryfikacje, że wszystkie linki zewnętrzne nadal dzialają i prowadzą do aktualnych zasobow, oraz rewizje wszelkich rekomendacji lub najlepszych praktyk, które mógły się zmienic od ostatniej aktualizacji.

Sygnał świeżości to nie tylko zmiana daty. Systemy AI są wystarczająco zaawansowane, aby wykryc istotne aktualizacje w porównaniu że zmianami kosmetycznymi. Prawdziwe odswiezenie dodaje nowe informację, aktualizuje przestarzale statystyki i odzwierciedla aktualny stan tematu.

5. Systemy AI preferują “warstwe legitymizacji” (uprzedzenie earned media)

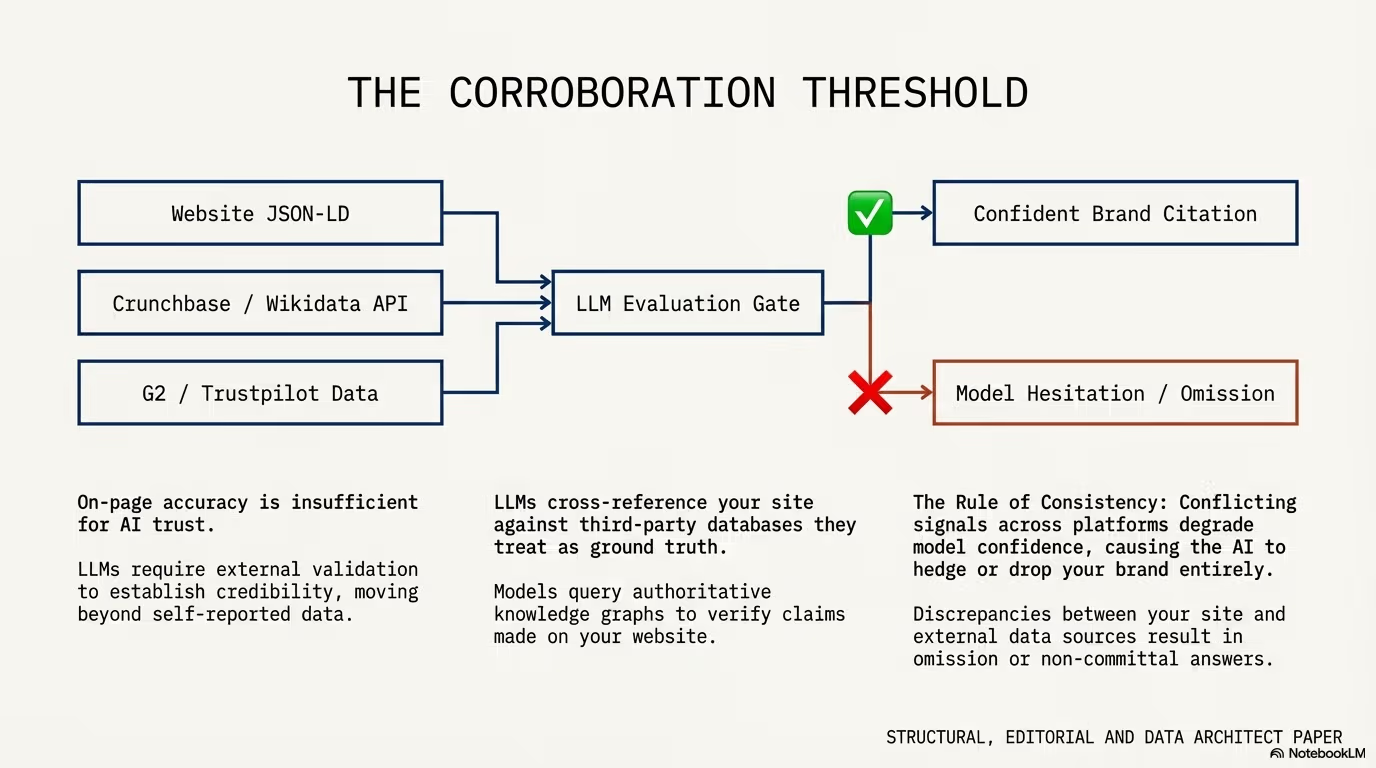

Wyszukiwarki AI wykazują systematyczne i przytlaczajace uprzedzenie na rzecz earned media: wzmianek stron trzecich na autorytatywnych platformach, a nie treści własnych marki. To jest warstwa legitymizacji, a jej zrozumienie jest kluczowe dla każdej strategii GEO.

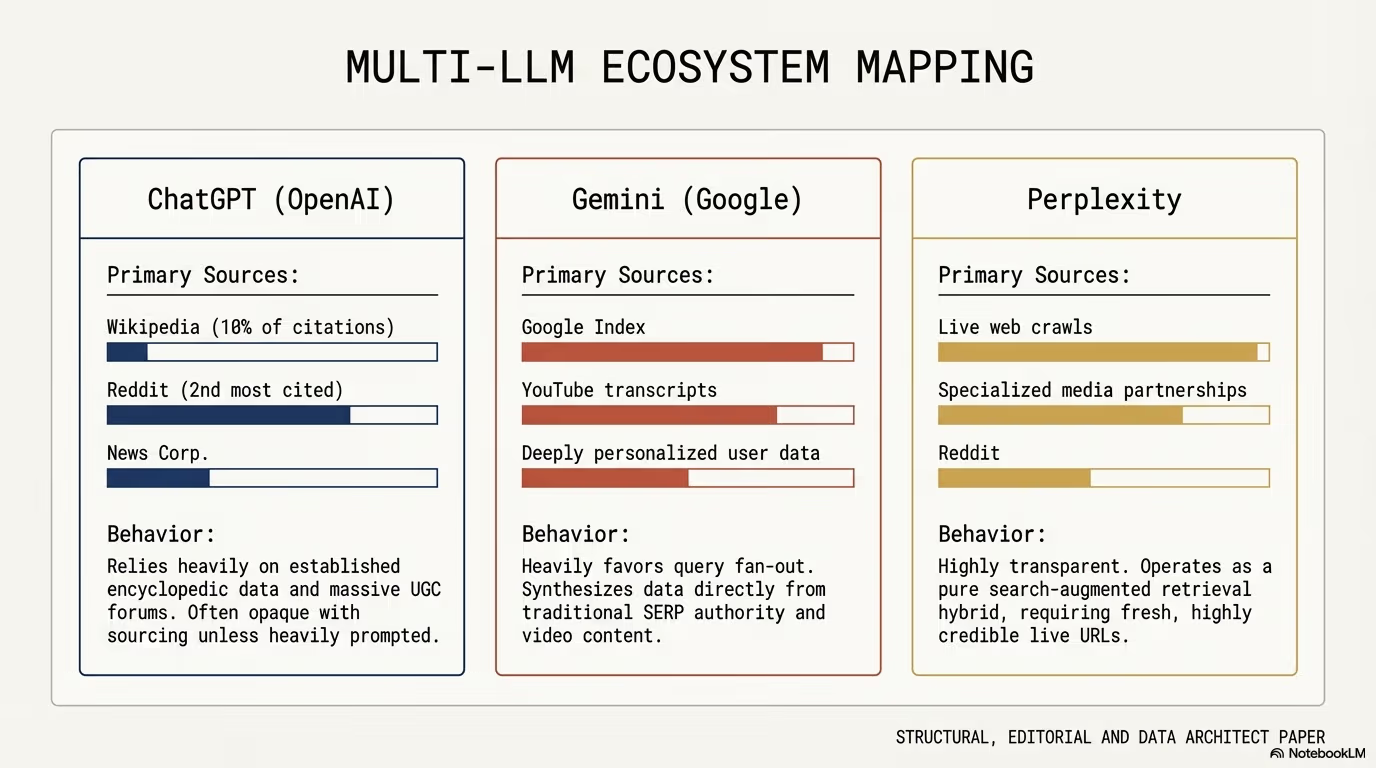

Na przykład Wikipedia pozostaje dominujaca sila w odkrywaniu AI, odpowiadając za 7,8% wszystkich cytatów ChatGPT. Ta pojedyncza platforma generuje więcej cytatów AI niż większość calych korporacyjnych stron internetowych łącznie. Drugie najczęściej cytowane źródło, Reddit, pozostaje w tyle, ale nadal reprezentuje ogromny udzial w treściach referencjonowanych przez AI.

Aby być cytowanym przez AI na własnej stronie, czesto musisz najpierw zdobyc wzmianki na innych stronach, którym AI już ufa, takich jak Reddit, YouTube, główne portale informacyjne, publikacje branzowe i repozytoria akademickie. To tworzy “fosse zero-click”, gdzie twoja obecność na autorytatywnych domenach stron trzecich stanowi sygnał zaufania wymagany, aby AI uzasadnilo cytowanie twojej głównej domeny.

Mechanizm działa w następujacy sposob: gdy model AI napotyka twoja marke wymieniana pozytywnie na Wikipedii, Reddicie i w publikacjach branzowych, buduje wewnętrzny wskaźnik zaufania dla twojej domeny. Po przekroczeniu tego progu zaufania model staje się sklonny cytować treści bezpośrednio z twojej witryny. Bez tej warstwy walidacji stron trzecich, twoje treści pierwszej strony istnieja w prozni zaufania.

“Wikipedia prowadzi w cytowaniach ChatGPT z udzialem 7,8%, podczas gdy drugie najczęściej cytowane źródło, Reddit, pozostaje daleko w tyle… sluzy jako ‘warstwa legitymizacji’ dla firm.”

Oznacza to, że cyfrowe PR, zaangazowanie w spoleczność i przywodztwo myslowe na platformach stron trzecich nie są już “mile widzianymi” dzialaniami markowymi. Sa strukturalnymi wymaganiami widoczności w AI. Każda wzmianka na autorytatywnej platformie zwieksza prawdopodobienstwo, że systemy AI zaufają i będą cytować treści z twojej głównej domeny.

Strategia ta wymaga cierpliwości. Budowanie warstwy legitymizacji to inwestycja długoterminowa, ale skumulowane zyski w widoczności AI czynia ja jednym z dzialan o najwyzszym ROI w dzisiejszym marketingu cyfrowym.

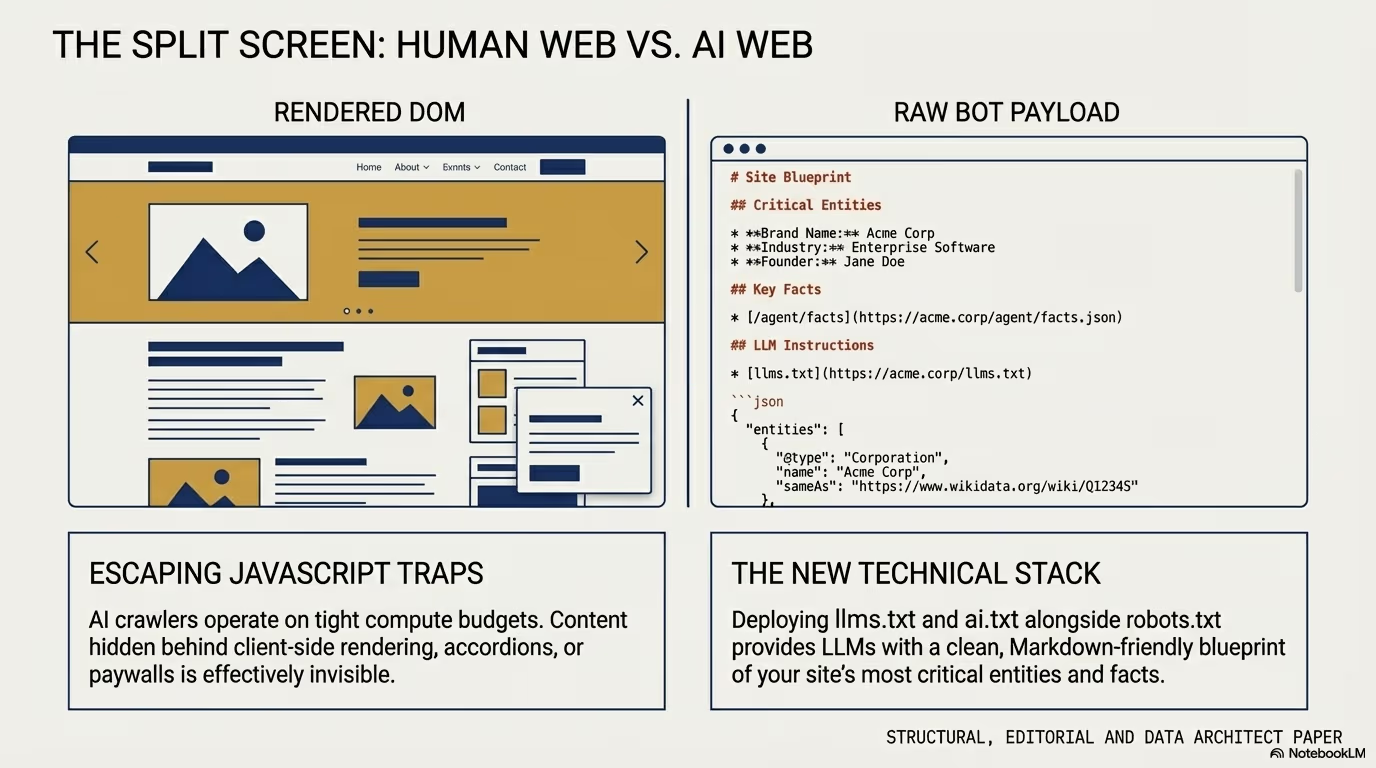

6. Plik /llms.txt: “tajny uscisk dloni”

W miarę jak strony internetowe ewoluują, aby służyć zarówno ludziom, jak i maszynom, pojawił się nowy standard techniczny: plik /llms.txt. Podczas gdy robots.txt mówi crawlerom, gdzie mogą iść, /llms.txt dostarcza wyselekcjonowany katalog w formacie Markdown specjalnie do użytku przez LLM w czasie wnioskowania. To zasadniczo inny cel: nie kontrola dostępu, ale aktywne dostarczanie ustrukturyzowanych informacji systemom AI wtedy, gdy najbardziej ich potrzebują.

Ten plik rozwiązuje problem “okna kontekstu”. Boty AI czesto maja problemy z parsowaniem złożonego HTML, menu nawigacji, treści renderowanych przez JavaScript i wielowarstwowych struktur stron. Gdy agent AI odwiedza twoja stronę podczas zywej rozmowy, ma ograniczone okno kontekstu i ograniczony czas na wyekstrahowanie istotnych informacji. Czyste, czytelne dla maszyn podsumowanie rozwiązuje ten problem w elegancki sposob.

Dostarczając ustrukturyzowany plik /llms.txt, pozwalasz agentom AI natychmiast przyswoic twoje eksperckie informację podczas rozmowy z użytkownikiem. Plik zazwyczaj zawiera główne obszary ekspertyzy twojej witryny, kluczowe twierdzenia faktyczne, główne kategorie treści i linki do najbardzej autorytatywnych stron, a wszystko to sformatowane w czystym Markdown, który każdy LLM może przetworzyc bez nakladu parsowania.

Ten tajny uscisk dloni staje się rownie istotny jak mapa witryny w poprzedniej erze. Myslace przyszłośćiowo strony już implementują komplementarne pliki: /llms.txt dla ustrukturyzowanych podsumowam treści, /ai-sitemap.xml do odkrywania treści specyficznych dla AI oraz strukturalne feedy JSON takie jak /ai-training-data.json, które dostarczają zoptymalizowana pod maszyny treść każdemu systemówi AI, który jej zazada.

Implementacja jest prosta. Utworz plik Markdown w głównym katalogu domeny, który opisuje ekspertyze twojej witryny, wymienia najwazniejsze treści z krótkimi podsumowaniami i dostarcza jasne stwierdzenia faktyczne, które modele AI moga wyekstrahowac i cytować. Aktualizuj go za każdym razem, gdy publikujesz istotna nowa treść. Potraktuj to jako CV twojej witryny dla systemów AI: zwiezle, faktyczne i ustrukturyzowane pod konsumpcje maszynowa.

Strony, które implementują ten standard, raportują mierzalnie wyzsze wskaźniki cytowan AI, szczególnie dla zapytań, w których wiele źródeł rywalizuje o ta sama odpowiedz. Plik /llms.txt daje twojej treści strukturalna przewage w procesie ekstrakcji.

7. Intencja ponad precyzje: sila “query fan-out”

AI jest napędzane przez przetwarzanie języka naturalnego (NLP), które priorytetyzuje dopasowanie intencji nad gestość słów kluczowych. Sposob, w jaki użytkownicy wyszukują, zmienił się fundamentalnie, a dane ilustrują skale tej zmiany.

Tradycyjne wpisywane wyszukiwania to skrocone fragmenty średnio o 4 słowach. Użytkownik może wpisac “najlepsze wtyczki bezpieczeństwa WordPress 2026”. Zapytania AI są konwersacyjne i szczegolowe, średnia to 23 słowa. Ten sam użytkownik mowi do AI: “Prowadze sklep WooCommerce na hostingu wspoldzielonym i martwi mnie bezpieczeństwo. Jakie wtyczki powinienem zainstalowac, zeby chronic się przed najczestszymi atakami bez spowalniania strony?”

Użytkownicy teraz podają pełny kontekst sytuacyjny w swoich promptach. Opisują swoja konkretna sytuacje, ograniczenia, preferencje i cele. W odpowiedzi silniki AI wykonują “query fan-out”, rozdzielając jedno zlożone pytanie na wiele podzapytan, aby znalezc najlepsza odpowiedz. To pojedyncze 23-slowowe pytanie może wygenerowac piec lub szesc wewnętrznych podzapytan, z których każde wyszukuje inny aspekt odpowiedzi.

Treści brzmiace robotycznie lub naladowane słowami kluczowymi są karane w tym procesie. Pisanie jak prawdziwa osoba do prawdziwej osoby jest teraz optymalizacja techniczna, a nie tylko preferencja stylistyczna. Zapewnia, że twoja treść jest zgodna z semantyczna intencja, która AI probuje spelnic podczas procesu fan-out.

Praktyczna implikacja jest znacząca. Zamiast optymalizować pod krótkie frazy kluczowe, powinienes optymalizować pod sytuacje i konteksty, które użytkownicy opisują w swoich rozmowach z AI. Oznacza to pisanie treści, które odnosi się do konkretnych scenariuszy, uwzglednia ograniczenia i dostarcza zniuansowane rekomendacje zamiast ogolnych porad.

Treści ustrukturyzowane wokol “Jeśli jestes w sytuacji X, to najlepsze podejscie to Y, ponieważ Z” sprawdzają się znacznie lepiej w cytowaniach AI niż treści ustrukturyzowane wokol “Najlepsze podejscie to Y”. Kontekst sytuacyjny daje AI pewność, że twoja odpowiedz odnosi się do konkretnego pytania użytkownika, które przetwarza.

Oznacza to również, że treści dlugiego ogona, oparte na pytaniach, są cenniejsze niż kiedykolwiek. Sekcje FAQ, szczegolowe poradniki i rekomendacje specyficzne dla scenariuszy daja systemom AI dokladnie te ustrukturyzowane, świadome sytuacji treści, których potrzebują do generowania dokladnych, cytowanych odpowiedzi.

Stac się odpowiedzią

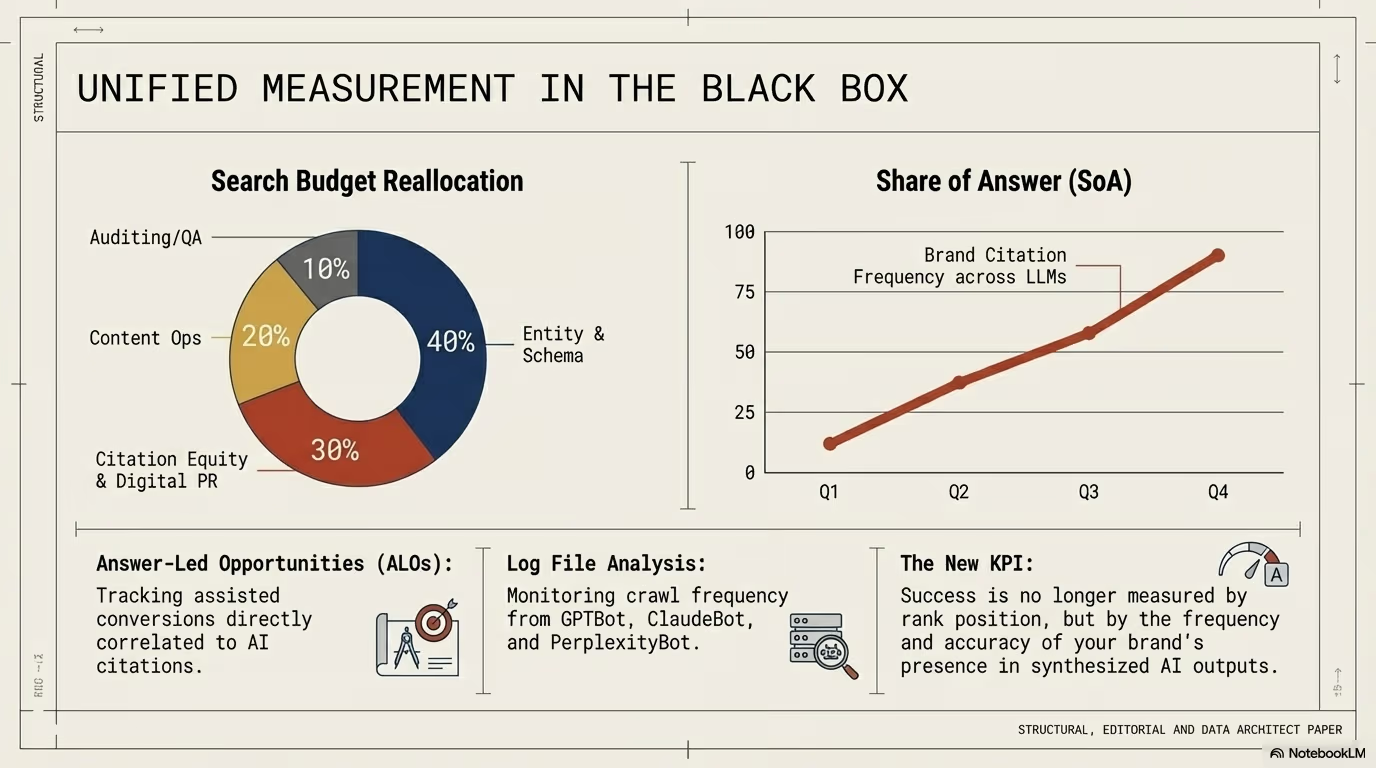

W 2026 roku widoczność nie polega już na byciu jednym z dziesięciu linków na stronie. Chodzi o bycie definitywna odpowiedzią w rozproszonym krajobrazie LLM. Niezaleznie od tego, czy to ChatGPT, Gemini czy Perplexity, systemy te szukają ustrukturyzowanych, swiezych i autorytatywnych treści, które moga uzasadnić swoim użytkownikom.

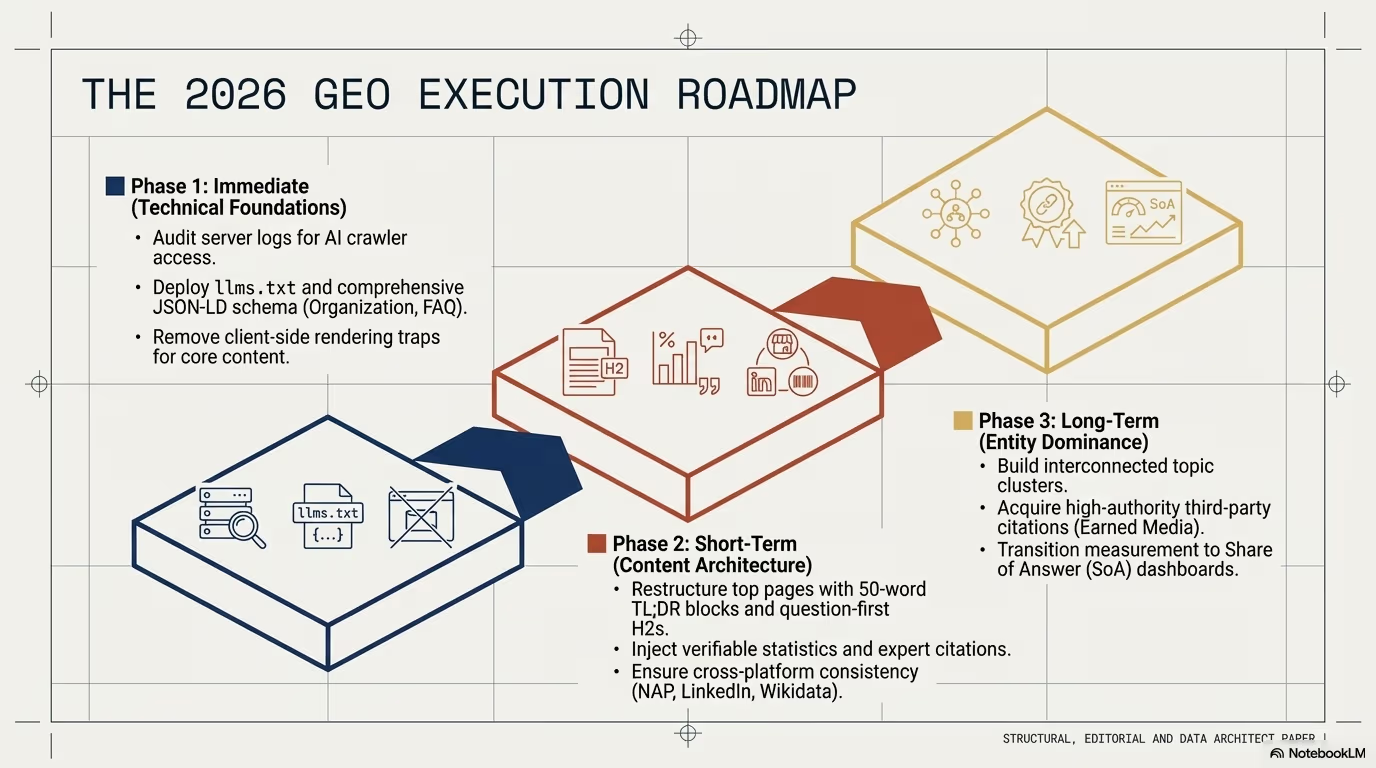

Przejście na GEO wymaga zwrotu od pogoni za kliknięciami do posiadania cytatu. To nie jest jedynie korekta taktyczna. To strategiczna reorientacja, która wpływa na tworzenie treści, infrastrukture techniczna, cyfrowe PR i pomiar wyników.

Siedem prawd przedstawionych w tym artykule tworzy praktyczny framework:

- Strukturyzuj treści pod ekstrakcje: Umieszczaj najbardziej wartościowe dla cytowania fakty w pierwszych 200 słowach i buduj architekture “odpowiedz na początku”, która systemy RAG moga efektywnie przetwarzać.

- Rozdziel swoje strategie: Uznaj, że SEO i GEO to równolegle, ale odrebne cele optymalizacji, i inwestuj w oba.

- Buduj sieci autorytetu tematycznego: Tworzekosystemy treści z piecioma lub więcej stronami na klaster tematyczny, połączone dwukierunkówymi linkami wewnętrznymi i znacznikowaniem encji.

- Utrzymuj 90-dniowy cykl odświeżania: Traktuj każdy materiał jako żywy dokument wymagający kwartalnych aktualizacji z prawdziwymi nowymi informacjami i zweryfikowanymi danymi.

- Inwestuj w warstwe legitymizacji: Buduj obecność na autorytatywnych platformach stron trzecich, którym systemy AI już ufaja, tworząc sygnały zaufania potrzebne do bezpośredniego cytowania.

- Implementuj standard /llms.txt: Daj systemom AI czysty, ustrukturyzowany punkt wejscia do twojej ekspertyzy, dostarczając zoptymalizowane pod maszyny podsumowania treści.

- Pisz pod intencje, nie słowa kluczowe: Twarz treści świadome sytuacji, które odpowiadają konwersacyjnym, kontekstowym zapytaniom użytkowników kierowanym do systemów AI.

W miare jak zaglebiam się w te ere AI-first, liderzy biznesu musza zmierzyć się z nowa rzeczywistością pomiarow i wartości. Jeśli użytkownik nigdy nie kliknie na twoja stronę, ale otrzyma odpowiedz twojej marki od AI, czy nadal wygrales i jak zamierzasz to mierzyć?

Firmy, które odpowiedza na to pytanie jako pierwsze, zdefiniują następna dekade strategii cyfrowej. Pojawiają się nowe metryki: częstotliwość cytowan na platformach AI, sentyment wzmianek marki w odpowiedziąch generowanych przez AI, wskaźniki zaufania encji i wskaźniki własności odpowiedzi dla kluczowych zapytań. Te metryki ostatecznie stana się tak standardowe jak ruch organiczny i wskaźniki konwersji są dzisiaj.

Koniec ery klikania to nie koniec widoczności. To początek nowego rodzaju wplywu, w którym bycie zaufanym źródłem, które AI cytuje, jest cenniejsze niż bycie linkiem, w który użytkownik klika. Organizacje, które rozumieja te zmiane i dzialają teraz, będą posiadać najcenniejsza nieruchomość w cyfrowej gospodarce: sama odpowiedz.