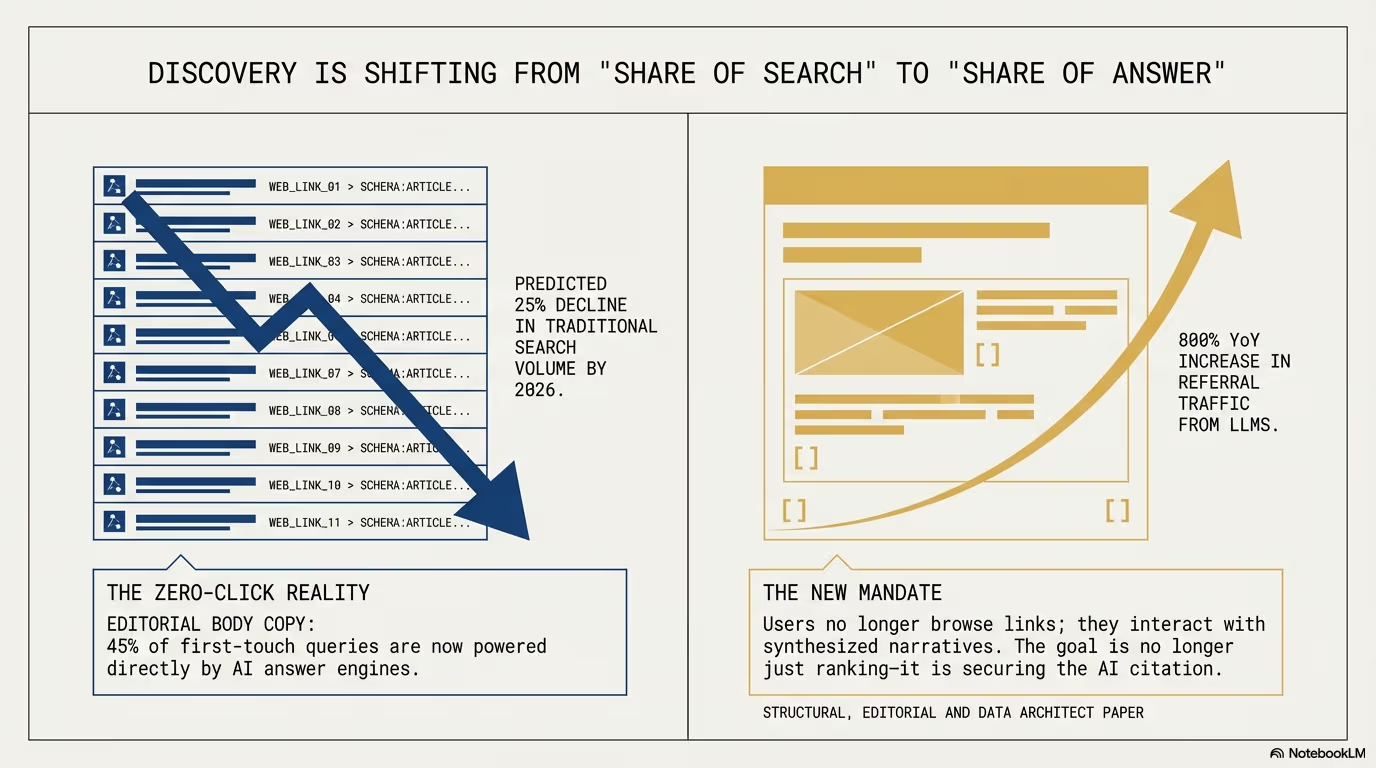

Bis 2026 hat die KI-Suche den blauen Link als primäres Tor zu Informationen ersetzt. Gartner prognostizierte einen 25%igen Rueckgang des traditionellen Suchvolumens, und mit einem Wachstum des KI-vermittelten Traffics von 527% im Jahresvergleich definieren diese 7 Wahrheiten das Überleben in der Zero-Click-Ära. Das Verstaendnis dieser Prinzipien ist unverzichtbar für jedes Unternehmen, das auf organische Sichtbarkeit angewiesen ist, denn die Regeln der Auffindbarkeit wurden von Grund auf neu geschrieben.

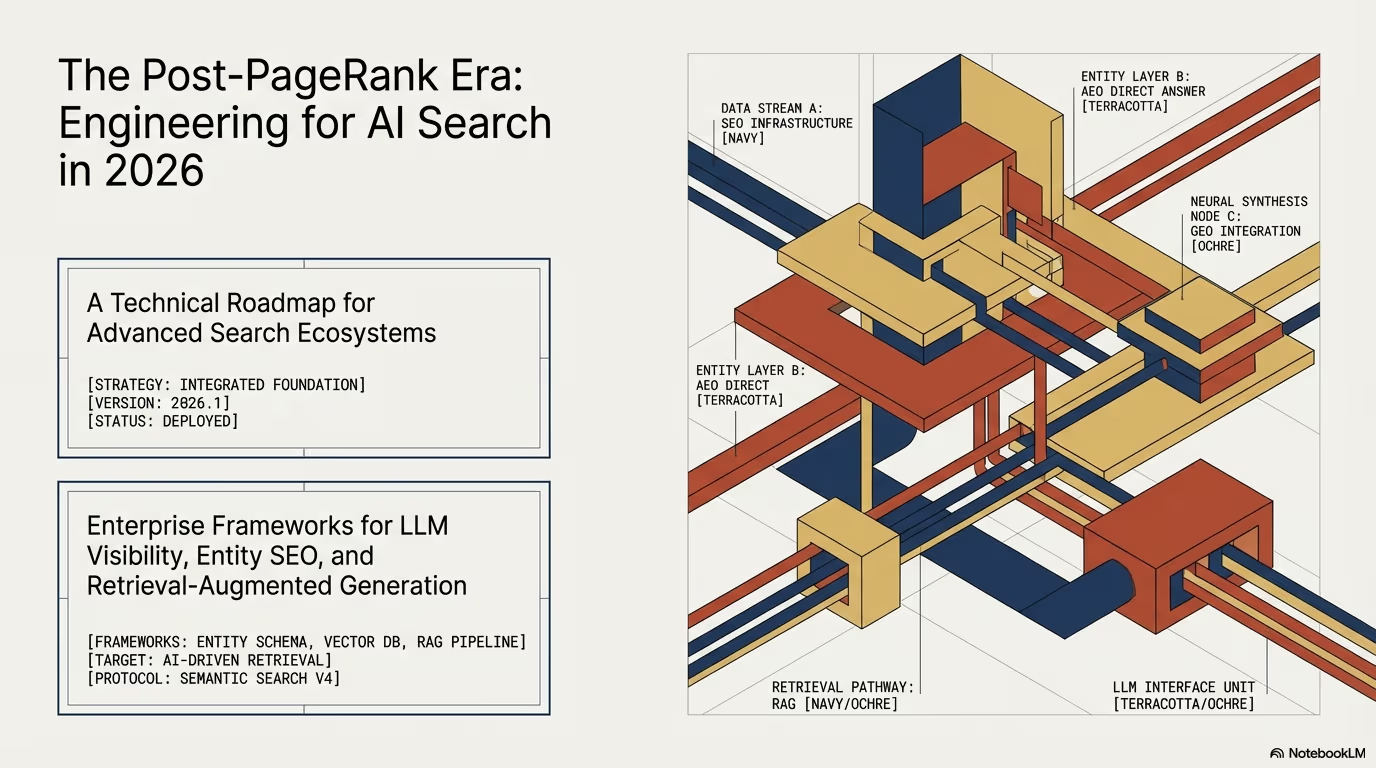

Der Wandel von SEO zu GEO

Die digitale Landschaft hat einen tektonischen Wandel durchlaufen. Jahrzehntelang war der blaue Link die primäre Waehrung des Internets, doch diese Ära ist vorbei. Wir sind über die Suchmaschine hinaus in das Zeitalter der Antwortmaschine eingetreten. Gartners Prognose eines 25%igen Rueckgangs des traditionellen Suchvolumens bis 2026 hat sich weitgehend bewahrheitet, und die Belege sind überall: Nutzer durchsuchen nicht mehr zehn blaue Links auf einer Ergebnisseite. Sie fuehren kontextreiche Gespraeche mit KI-Systemen, die Informationen synthetisieren und Antworten direkt liefern.

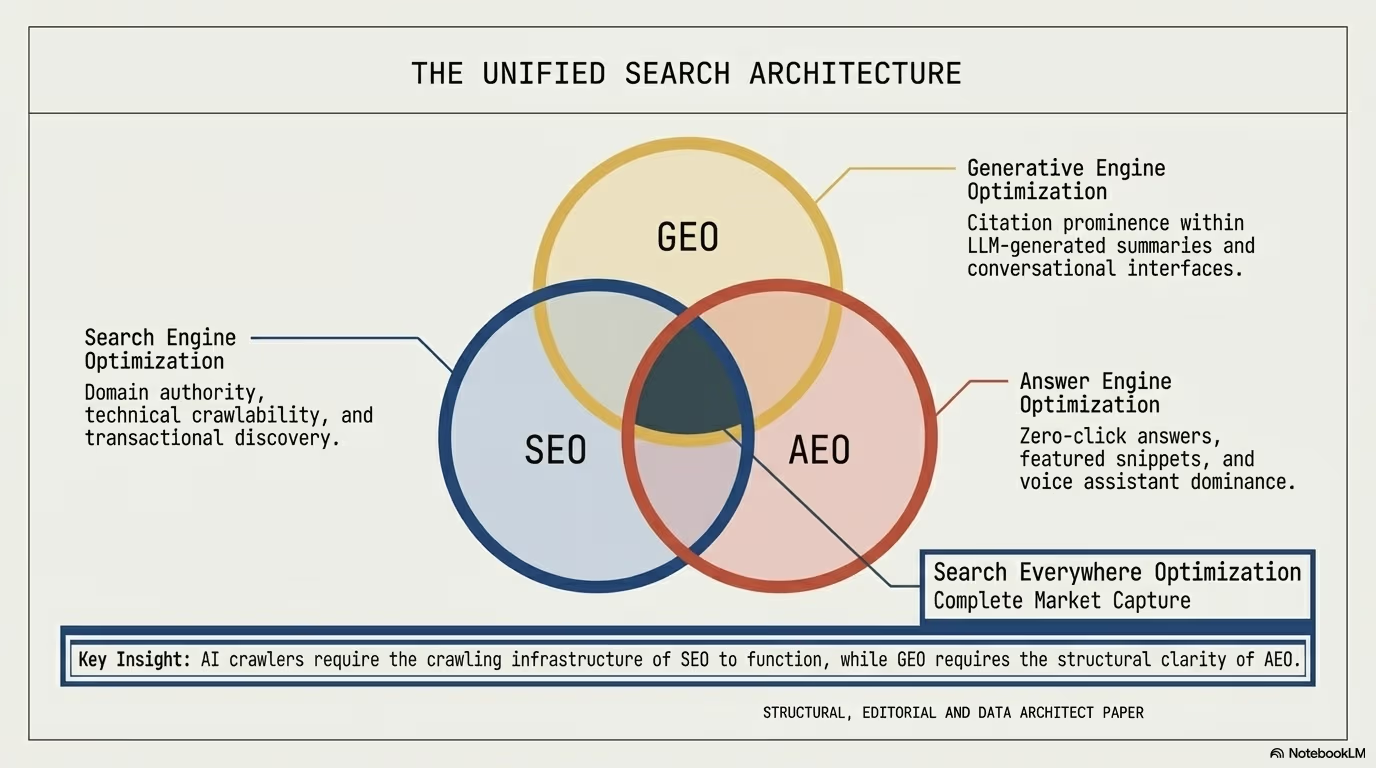

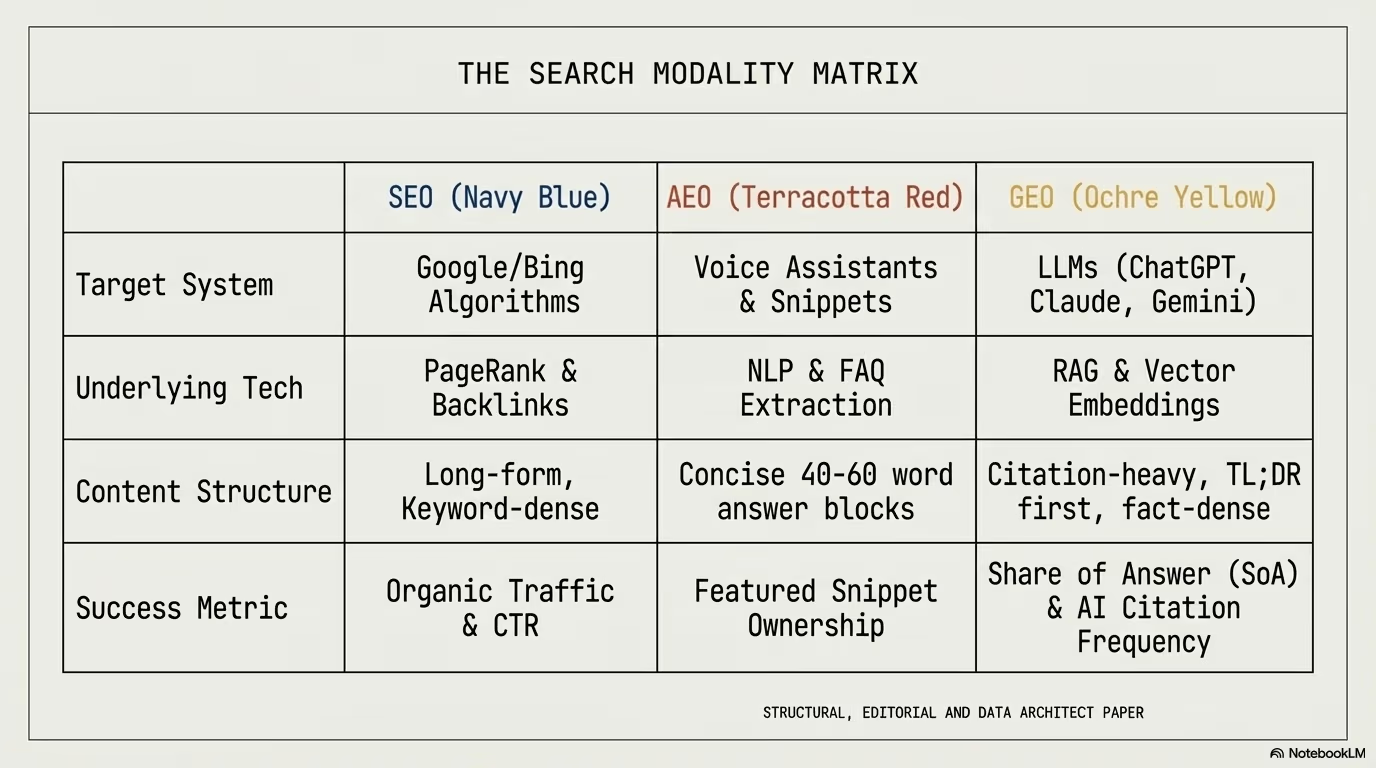

Dies ist der Übergang von Search Engine Optimization (SEO) zu Generative Engine Optimization (GEO). In diesem neuen Paradigma geht es bei Sichtbarkeit nicht darum, Nummer eins auf einer Liste zu sein. Es geht darum, selbst die synthetisierte Antwort zu werden. Die Auswirkungen sind tiefgreifend für jedes Unternehmen, das in traditionelles Suchmaschinenmarketing investiert hat.

Mit einem Wachstum des KI-vermittelten Traffics von erstaunlichen 527% im Jahresvergleich repraesentieren die folgenden sieben Erkenntnisse die neuen Gesetze des Überlebens in einer KI-first, Zero-Click-Welt. Jede einzelne wird durch Daten gestuetzt, und zusammen bilden sie ein umfassendes Playbook zur Anpassung Ihrer digitalen Strategie an die Realitaeten von 2026.

Der entscheidende Unterschied zwischen SEO und GEO liegt darin, was jedes System belohnt. SEO belohnt Seiten, die durch überzeugende Titel und Meta-Beschreibungen menschliche Klicks anziehen. GEO belohnt Seiten, denen KI-Systeme genug vertrauen, um sie als autoritative Quellen zu zitieren. Dies sind grundlegend unterschiedliche Optimierungsziele, und wer sie gleichsetzt, laesst seine Inhalte zwischen zwei Paradigmen stranden.

1. Die “TLDR”-Regel: Zitate werden in den ersten 200 Wörtern gewonnen

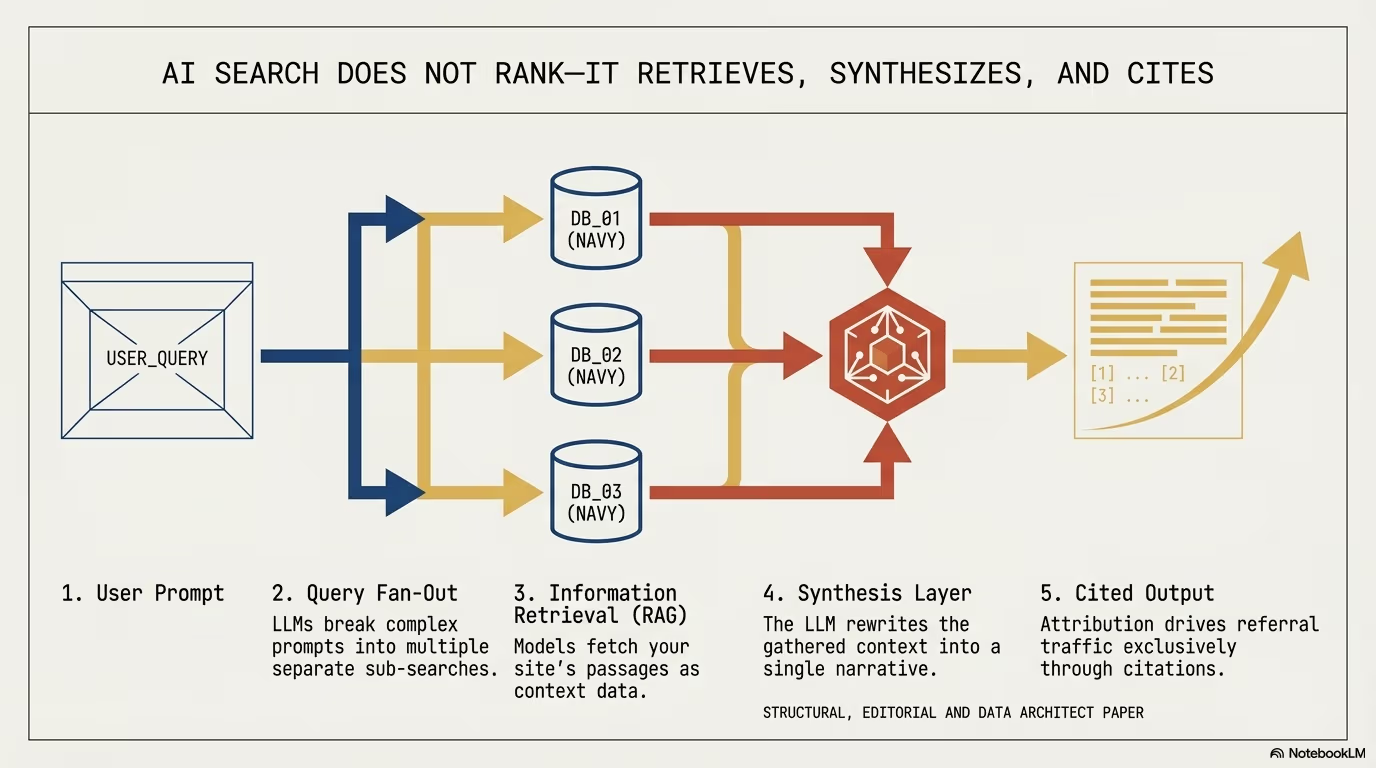

Die Zeiten, in denen man den Kern der Sache begrub, um Time-on-Page-Metriken aufzublaehen, sind offiziell vorbei. Moderne KI-Abrufsysteme nutzen Retrieval-Augmented Generation (RAG), einen Prozess, der auf extreme Effizienz ausgelegt ist. Diese Systeme lesen nicht Ihren gesamten Artikel von oben bis unten. Sie extrahieren spezifische Passagen, um den Modellkontext zu speisen, und der Extraktionsprozess bevorzugt stark Inhalte, die frueh im Dokument erscheinen.

Daten zeigen, dass 44,2% aller verifizierten LLM-Zitate aus den ersten 30% einer Seite stammen. Allein diese Statistik sollte die Art und Weise umgestalten, wie jedes Content-Team die Artikelstruktur angeht. Wenn die direkte Antwort nicht in Ihren Eröffnungsabsaetzen steht, existiert Ihr Inhält für die Maschine praktisch nicht.

Um das Zitat zu gewinnen, müssen Sie eine “Antwort-zuerst”-Architektur anwenden: Beginnen Sie mit einer praegnanten Zusammenfassung unter 300 Wörtern, die die primäre Anfrage direkt beantwortet, gefolgt von datenreichen Nuancen und stuetzenden Belegen. Stellen Sie es sich so vor, als würden Sie eine Executive Summary schreiben, die eine Maschine isoliert extrahieren kann und dennoch eine vollstaendige, akkurate Antwort für den Nutzer liefert.

Das bedeutet nicht, dass Ihr Inhält oberflaechlich sein sollte. Ganz im Gegenteil. Die Tiefe muss vorhanden sein, aber die Architektur muss umgekehrt werden. Platzieren Sie Ihre zitationswuerdigsten Fakten, Statistiken und deklarativen Aussagen im Eröffnungsabschnitt. Nutzen Sie dann den verbleibenden Inhalt, um den Kontext, die Belege und die Nuancen zu liefern, die Autoritaet aufbauen.

“Beantworten Sie zuerst die Frage, dann erklaeren Sie die Nuancen. So sollten Sie das Schreiben für KI-Suche generell angehen: Klarheit zuerst, Tiefe zweitens.”

Die praktische Konsequenz ist, dass jeder Inhält eine Art “Zitations-Header” benötigt: einen dichten, faktenreichen Eröffnungsabschnitt, der speziell für die RAG-Extraktion konzipiert ist. Dieser Abschnitt sollte Ihr primäres Keyword natürlich enthalten, eine direkte Antwort auf die Zielanfrage und mindestens zwei stuetzende Datenpunkte. Alles Weitere baut auf diesem Fundament auf.

2. Der 83%-Schock: Rang eins garantiert keine KI-Sichtbarkeit mehr

Eine der disruptivsten Erkenntnisse für Unternehmensfuehrer ist, dass sich traditionelle Google-Rankings von KI-Zitaten entkoppelt haben. Die Überschneidung zwischen den bestplatzierten Google-Links und den von KI-Engines zitierten Quellen ist unter 20% gefallen. Das bedeutet, dass vier von fuenf KI-Zitaten von Quellen stammen, die auf einer traditionellen Top-10-Ergebnisseite nicht erscheinen würden.

Noch schockierender: Forschung von Digital Applied zeigt, dass 83% der AI-Overview-Zitate von Seiten stammen, die außerhalb der organischen Top 10 ranken. Diese Statistik zerstoert die Annahme, dass gutes SEO automatisch zu KI-Sichtbarkeit führt. Die beiden Systeme bewerten Inhalte durch grundlegend unterschiedliche Linsen.

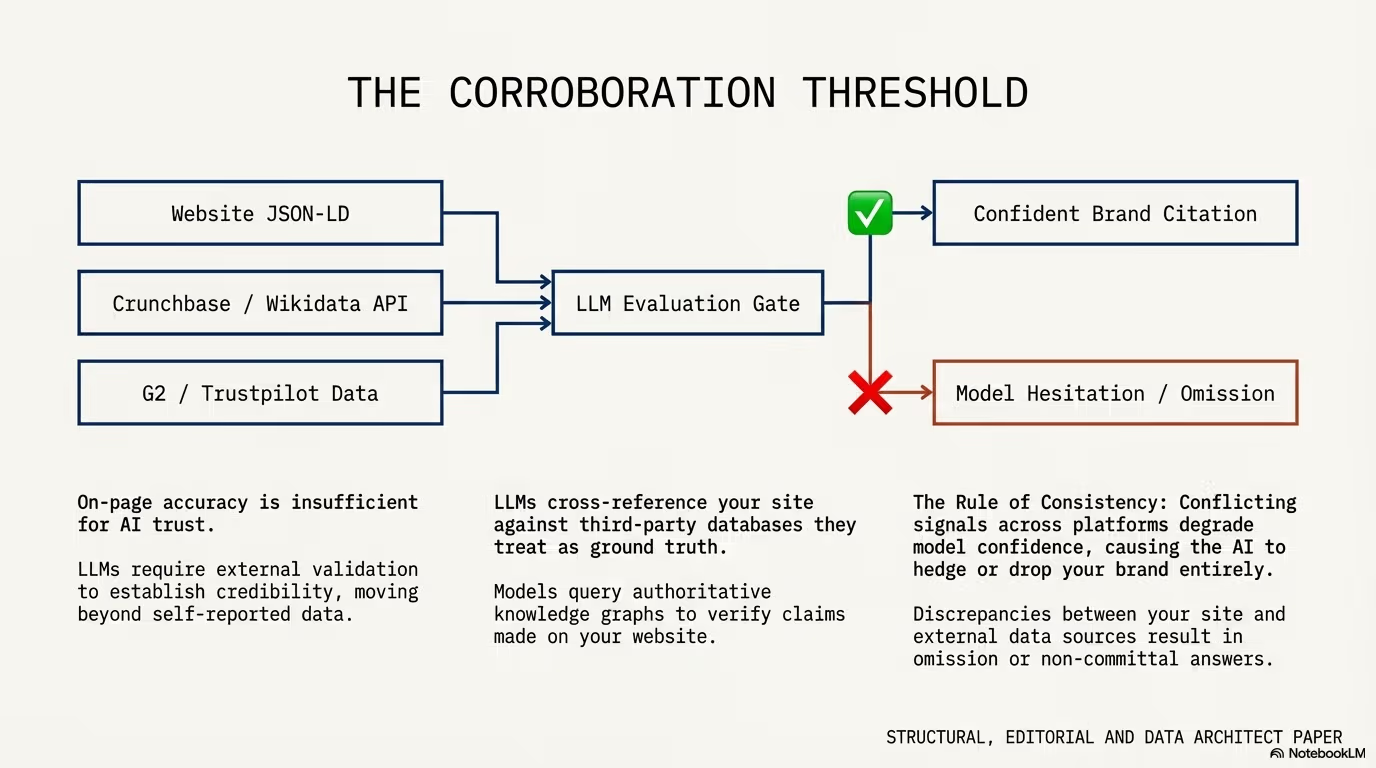

KI-Modelle priorisieren maschinenextrahierbare Fakten und strukturelle Klarheit gegenüber den backlink-lastigen Signalen des klassischen SEO. Während Googles Algorithmus Domain-Autoritaet, Link-Equity und Nutzer-Engagement-Metriken gewichtet, bewerten KI-Systeme, wie leicht sie eine verifizierbare Tatsache extrahieren können, wie klar der Inhält strukturiert ist und wie zuversichtlich sie in die Genauigkeit der Information sein können.

Diese Entkopplung bedeutet, dass Ihre “SEO-perfekte” Website für genau die KI-Modelle unsichtbar sein koennte, die jetzt die Anfragen Ihrer Kunden bearbeiten. Sie bedeutet aber auch Chancen: Eine kleinere Website mit aussergewoehnlicher Inhaltsstruktur, klaren faktischen Aussagen und starkem Entity-Markup kann einen Domain-Autoritaets-Riesen bei KI-Zitaten übertreffen.

Die praktische Erkenntnis ist, dass Unternehmen parallele Optimierungsstrategien brauchen. Ihre SEO-Bemuehungen sollten fortgesetzt werden, aber Sie müssen GEO-spezifische Optimierungen darauf aufbauen: Structured-Data-Markup, klare faktische Aussagen in den ersten 200 Wörtern, Entity-Level-Schema-Implementierung und regelmäßige Inhaltsfreshe-Updates. SEO ohne GEO im Jahr 2026 zu betreiben ist wie die Optimierung für Desktop im Jahr 2015, während man Mobile ignoriert.

3. Autoritaet ist ein Netz, keine Seite (der 3,2x-Multiplikator)

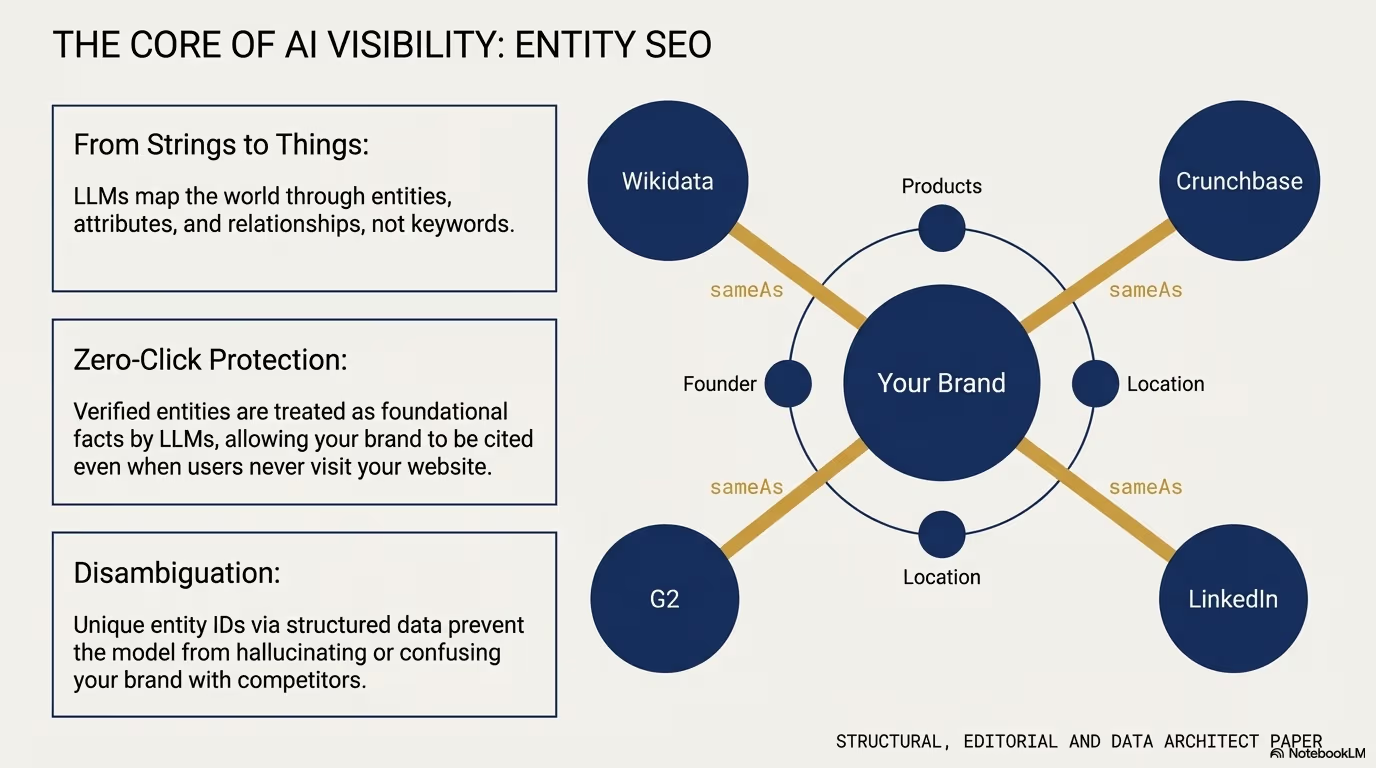

KI-Engines suchen nicht nur nach einer guten Seite. Sie verifizieren eine thematische Graphen-Autoritaet. Der Wandel zu einer Entity-First-Architektur ist jetzt das strukturelle Fundament von GEO, und die Daten, die dies belegen, sind überzeugend.

Die Analyse von Millionen KI-Zitaten bestaetigt, dass 86% der Zitate von Websites mit fuenf oder mehr vernetzten Seiten zu einem bestimmten Thema stammen. Isolierte Seiten, egal wie gut geschrieben, verdienen selten KI-Zitate, weil das generative Modell die breitere Autoritaet der Quelle nicht verifizieren kann.

Die Verwendung einer Pillar-Cluster-Architektur bietet einen 3,2-fachen Anstieg der Zitationsraten. KI-Systeme müssen ein dichtes Netzwerk bidirektionaler interner Links sehen, um sich sicher genug zu fuehlen, Ihre Marke als definitive Autoritaet zu zitieren. Ohne dieses Kontextnetz bleiben einzelne Seiten verwaist und von generativen Modellen nicht vertraut.

Wie sieht das in der Praxis aus? Es bedeutet, Content-Oekosysteme aufzubauen, keine isolierten Artikel. Eine Pillar-Seite behandelt das breite Thema umfassend, und Cluster-Seiten tauchen tief in Unterthemen ein, während sie zurück zur Pillar-Seite und zueinander verlinken. Die interne Linkstruktur erzeugt ein semantisches Netz, das KI durchqueren kann, um Autoritaet zu verifizieren.

Zum Beispiel sollte eine Website, die “WordPress-Sicherheit” als Pillar abdeckt, vernetzte Cluster-Seiten zu Firewall-Konfiguration, Malware-Erkennung, Login-Haertung, SSL-Implementierung, Plugin-Schwachstellenscanning und Incident Response haben. Jede Seite verlinkt auf die anderen mit beschreibendem Ankertext und erzeugt so einen dichten Wissensgraphen, den KI-Systeme navigieren und dem sie vertrauen können.

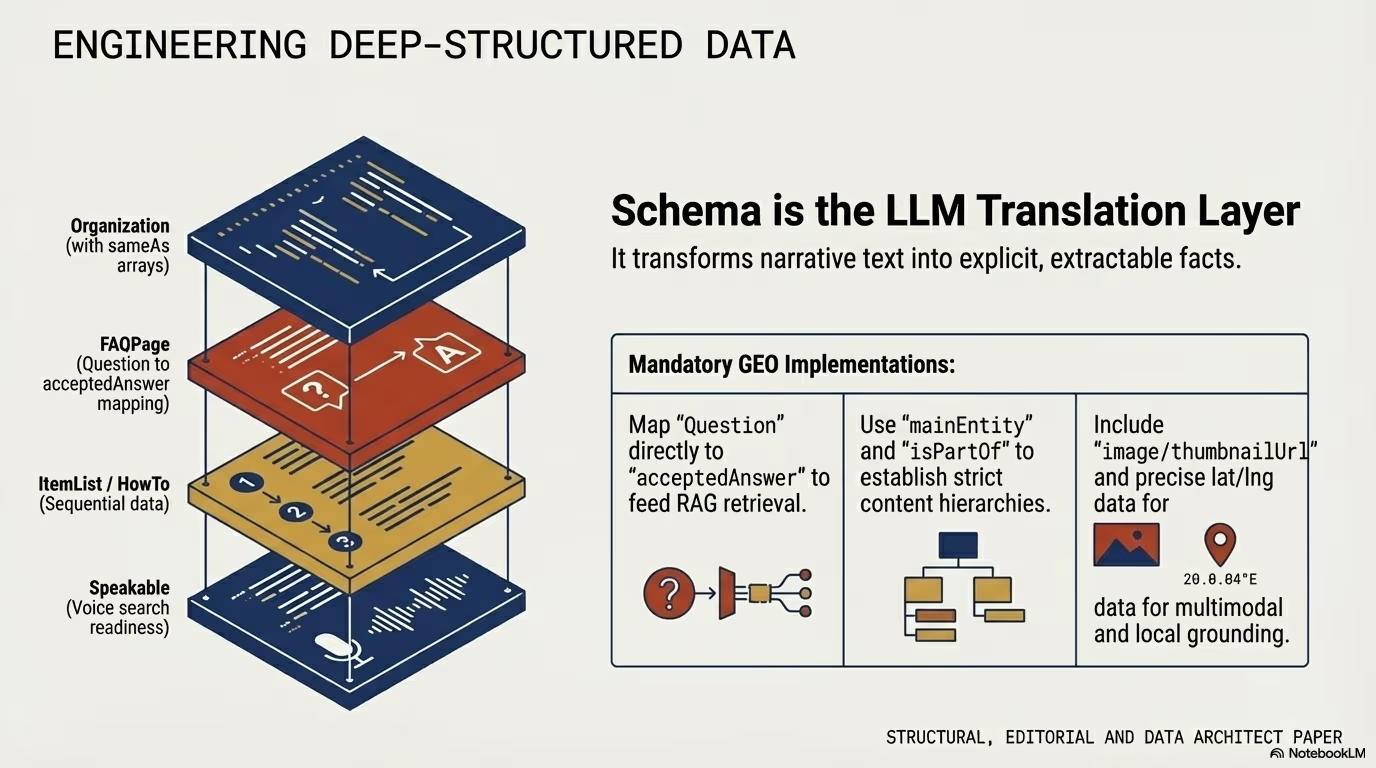

Der Entity-First-Ansatz geht noch weiter. Jedes Schluesselkonzept auf Ihrer Website sollte mit der entsprechenden Wikidata-Entität verknuepft sein, und Ihre strukturierten Daten sollten Entity-Beziehungen klar ausdruecken. Wenn ein KI-System einen klaren Entity-Graphen über Ihre Inhalte nachverfolgen kann, behandelt es Ihre Website als Wissensdatenbank statt als Sammlung unzusammenhaengender Artikel.

4. Die 90-Tage-Frische-Klippe

In der KI-Ära haben Inhalte eine kuerzere Haltbarkeit als je zuvor. KI-Systeme zeigen einen massiven Aktualitaets-Bias und priorisieren aktuelle Informationen, um Halluzinationen oder veraltete Ratschlaege zu vermeiden. Die Datenlage dazu ist eindeutig und verlangt Aufmerksamkeit von jedem Content-Strategen.

Innerhalb von 90 Tagen aktualisierte Inhalte erzielen 2x hoehere Zitationsraten im Vergleich zu aelterem Material. Dies ist keine marginale Verbesserung. Es ist eine binaere Unterscheidung zwischen Inhalten, die zitiert werden, und Inhalten, die ignoriert werden.

Umgekehrt werden Inhalte, die seit über 18 Monaten nicht aktualisiert wurden, von generativen Engines weitgehend ignoriert, unabhaengig von ihrer historischen Autoritaet. Eine Seite, die einst Tausende von Backlinks gesammelt hat und jahrelang auf Platz eins rankte, kann für KI-Systeme unsichtbar werden, nur weil sie nicht mit aktuellen Daten und verifizierten Fakten aufgefrischt wurde.

Das statische “Veröffentlichen und Vergessen”-Modell wurde durch einen obligatorischen vierteljährlichen Aktualisierungszyklus ersetzt. Wenn Ihre Daten nicht frisch sind, findet die KI einfach einen Wettbewerber, dessen Daten es sind. Dies repraesentiert einen fundamentalen Wandel in der Content-Oekonomie: Die Kosten für die Pflege von Inhalten sind jetzt ebenso wichtig wie die Kosten für ihre Erstellung.

Praktische Schritte zur Aufrechterhaltung der Freshe umfassen: vierteljährliche Aktualisierung von Statistiken und Datenpunkten, Hinzufügen neuer Abschnitte zu aufkommenden Unterthemen, Auffrischung von Veröffentlichungs- und Änderungsdaten bei echten inhaltlichen Änderungen, Überprüfung, ob alle externen Links noch funktionieren und auf aktuelle Ressourcen verweisen, sowie Überarbeitung von Empfehlungen oder Best Practices, die sich seit dem letzten Update geaendert haben koennten.

Das Freshe-Signal ist nicht nur eine Frage des Datums. KI-Systeme sind ausreichend ausgereift, um substanzielle Updates von kosmetischen Änderungen zu unterscheiden. Eine echte Aktualisierung fuegt neue Informationen hinzu, aktualisiert veraltete Statistiken und spiegelt den aktuellen Stand des Themas wider.

5. KI-Systeme bevorzugen die “Legitimitaetsschicht” (der Earned-Media-Bias)

KI-Suchmaschinen zeigen eine systematische und überwaeltigende Praeferenz für Earned Media: Erwaenungen Dritter auf autoritativen Plattformen, nicht markeneigene Inhalte. Dies ist die Legitimitaetsschicht, und ihr Verstaendnis ist entscheidend für jede GEO-Strategie.

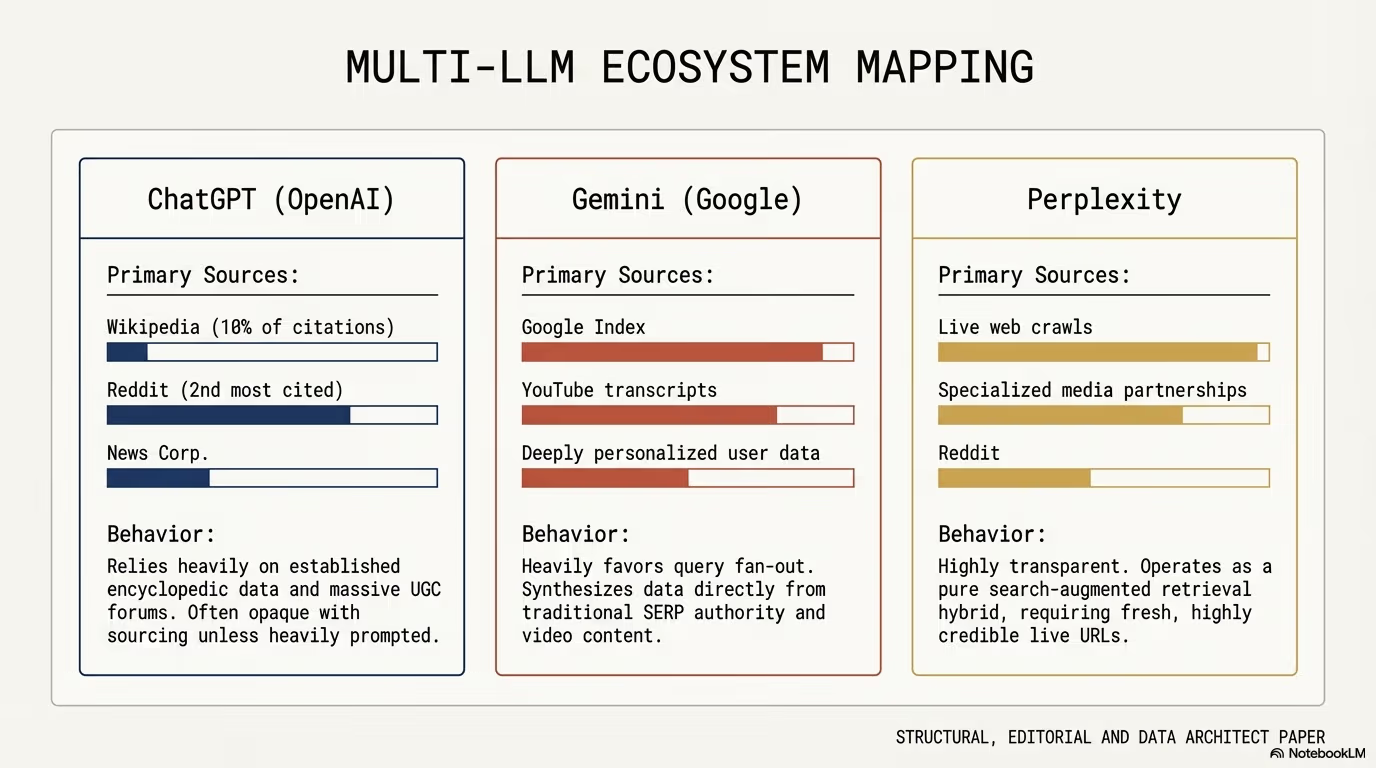

Zum Beispiel bleibt Wikipedia eine dominierende Kraft bei der KI-Entdeckung und macht 7,8% aller ChatGPT-Zitate aus. Diese einzelne Plattform generiert mehr KI-Zitate als die meisten gesamten Unternehmenswebsites zusammen. Die am zweithäufigsten zitierte Quelle, Reddit, liegt zwar dahinter, repraesentiert aber immer noch einen massiven Anteil an KI-referenzierten Inhalten.

Um von KI auf Ihrer eigenen Website zitiert zu werden, müssen Sie oft zuerst Erwaenungen auf anderen Websites verdienen, denen die KI bereits vertraut, wie Reddit, YouTube, große Nachrichtenportale, Branchenpublikationen und akademische Repositorien. Dies schafft einen “Zero-Click-Graben”, bei dem Ihre Praesenz auf autoritativen Drittanbieter-Domains als Vertrauenssignal dient, das eine KI benötigt, um das Zitieren Ihrer Hauptdomain zu rechtfertigen.

Der Mechanismus funktioniert folgendermassen: Wenn ein KI-Modell Ihre Marke positiv auf Wikipedia, Reddit und in Branchenpublikationen erwähnt findet, baut es einen internen Vertrauenswert für Ihre Domain auf. Sobald diese Vertrauensschwelle überschritten ist, wird das Modell bereit, Inhalte direkt von Ihrer Website zu zitieren. Ohne diese Drittanbieter-Validierungsschicht existieren Ihre First-Party-Inhalte in einem Vertrauensvakuum.

“Wikipedia führt die ChatGPT-Zitate an mit einem Anteil von 7,8%, während die zweithäufigst zitierte Quelle, Reddit, weit abgeschlagen ist… es dient als ‘Legitimitaetsschicht’ für Unternehmen.”

Das bedeutet, dass digitale PR, Community-Engagement und Thought Leadership auf Drittanbieter-Plattformen keine “Nice-to-have”-Markenaktivitaeten mehr sind. Sie sind strukturelle Voraussetzungen für KI-Sichtbarkeit. Jede Erwaehnung auf einer autoritativen Plattform erhoecht die Wahrscheinlichkeit, dass KI-Systeme Ihren primären Domain-Inhält vertrauen und zitieren.

Die Strategie erfordert Geduld. Der Aufbau der Legitimitaetsschicht ist eine langfristige Investition, aber die kumulierenden Renditen bei der KI-Sichtbarkeit machen sie zu einer der Aktivitaeten mit dem höchsten ROI im digitalen Marketing heute.

6. Der /llms.txt “geheime Handschlag”

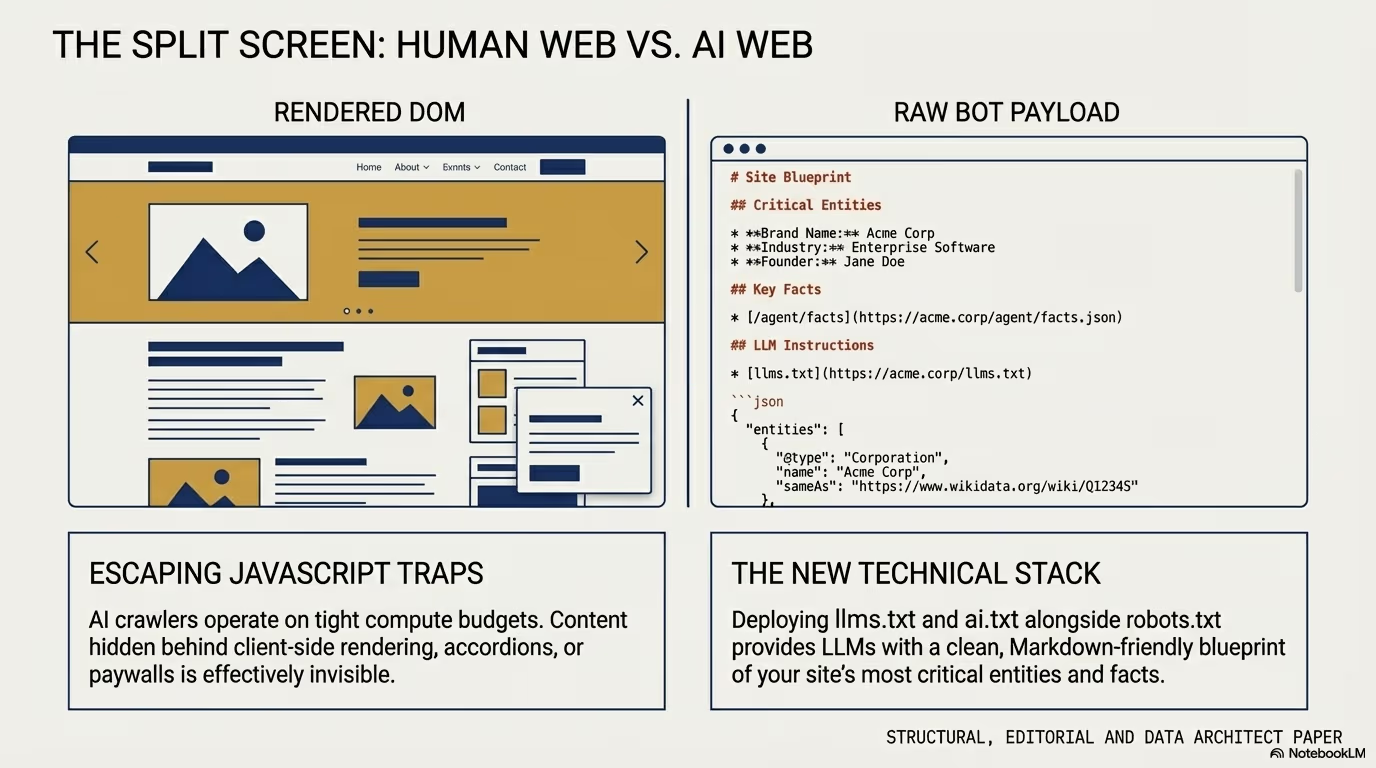

Da Websites sich weiterentwickeln, um sowohl Menschen als auch Maschinen zu dienen, ist ein neuer technischer Standard entstanden: die /llms.txt-Datei. Während robots.txt Crawlern sagt, wohin sie gehen können, bietet /llms.txt ein kuratiertes, Markdown-formatiertes Verzeichnis speziell für die Inferenz-Zeit-Nutzung durch LLMs. Dies ist ein grundlegend anderer Zweck: nicht die Zugangssteuerung, sondern die aktive Bereitstellung strukturierter Informationen für KI-Systeme, wenn sie diese am meisten brauchen.

Diese Datei loest das “Kontextfenster”-Problem. KI-Bots haben oft Schwierigkeiten, komplexes HTML, Navigationsmenus, JavaScript-gerenderte Inhalte und mehrschichtige Seitenstrukturen zu parsen. Wenn ein KI-Agent Ihre Website während eines Live-Gespraeches besucht, hat er ein begrenztes Kontextfenster und begrenzte Zeit, um relevante Informationen zu extrahieren. Eine saubere, maschinenlesbare Zusammenfassung loest dieses Problem elegant.

Durch die Bereitstellung einer strukturierten /llms.txt-Datei ermöglichen Sie KI-Agenten, Ihre Expertendaten sofort während eines Nutzergespraeches aufzunehmen. Die Datei enthaelt typischerweise die Kernkompetenzenbereiche Ihrer Website, zentrale faktische Aussagen, primäre Inhaltskategorien und Links zu Ihren autoritativsten Seiten, alles formatiert in sauberem Markdown, das jedes LLM ohne Parsing-Overhead verarbeiten kann.

Dieser geheime Handschlag wird so wesentlich wie die Sitemap in der vorherigen Ära. Zukunftsorientierte Websites implementieren bereits ergänzende Dateien: /llms.txt für strukturierte Inhaltszusammenfassungen, /ai-sitemap.xml für KI-spezifische Inhaltserkennung und strukturierte JSON-Feeds wie /ai-training-data.json, die maschinenoptimierte Inhalte für jedes KI-System bereitstellen, das sie anfordert.

Die Implementierung ist unkompliziert. Erstellen Sie eine Markdown-Datei im Stammverzeichnis Ihrer Domain, die die Expertise Ihrer Website beschreibt, Ihre wichtigsten Inhalte mit kurzen Zusammenfassungen auflistet und klare faktische Aussagen liefert, die KI-Modelle extrahieren und zitieren können. Aktualisieren Sie sie, wann immer Sie bedeutende neue Inhalte veröffentlichen. Stellen Sie sich die Datei als den Lebenslauf Ihrer Website für KI-Systeme vor: praegnant, faktisch und für maschinelle Verarbeitung strukturiert.

Websites, die diesen Standard implementieren, berichten über messbar hoehere KI-Zitationsraten, insbesondere bei Anfragen, bei denen mehrere Quellen um dieselbe Antwort konkurrieren. Die /llms.txt-Datei verschafft Ihren Inhalten einen strukturellen Vorteil im Extraktionsprozess.

7. Absicht über Praezision: die Kraft des “Query Fan-out”

KI wird von Natural Language Processing (NLP) angetrieben, das Intent-Matching gegenüber Keyword-Dichte priorisiert. Die Art und Weise, wie Nutzer suchen, hat sich grundlegend veraendert, und die Daten veranschaulichen das Ausmass dieses Wandels.

Traditionelle getippte Suchen sind abgekuerzte Fragmente mit durchschnittlich 4 Wörtern. Ein Nutzer tippt vielleicht “beste WordPress Sicherheits-Plugins 2026”. KI-Anfragen sind konversationell und detailliert mit durchschnittlich 23 Wörtern. Derselbe Nutzer sagt einer KI: “Ich betreibe einen WooCommerce-Shop auf Shared Hosting und mache mir Sorgen um die Sicherheit. Welche Plugins sollte ich installieren, um mich gegen die häufigsten Angriffe zu schuetzen, ohne meine Seite zu verlangsamen?”

Nutzer liefern jetzt den vollstaendigen situativen Kontext in ihren Prompts. Sie beschreiben ihre spezifische Situation, Einschraenkungen, Praeferenzen und Ziele. Als Antwort fuehren KI-Engines “Query Fan-out” durch und brechen eine komplexe Frage in mehrere Teilanfragen auf, um die beste Antwort zu finden. Diese einzelne 23-Woerter-Frage koennte fuenf oder sechs interne Teilanfragen generieren, die jeweils nach verschiedenen Aspekten der Antwort suchen.

Inhalte, die roboterhaft oder keyword-überladen klingen, werden in diesem Prozess bestraft. Wie ein echter Mensch für einen echten Menschen zu schreiben, ist jetzt eine technische Optimierung, nicht nur eine stilistische Praeferenz. Es stellt sicher, dass Ihr Inhält mit der semantischen Absicht übereinstimmt, die die KI während ihres Fan-out-Prozesses zu erfuellen versucht.

Die praktische Konsequenz ist bedeutsam. Statt für kurze Keyword-Phrasen zu optimieren, sollten Sie für die Situationen und Kontexte optimieren, die Nutzer in ihren KI-Gespraechen beschreiben. Das bedeutet, Inhalte zu schreiben, die spezifische Szenarien ansprechen, Einschraenkungen anerkennen und nuancierte Empfehlungen statt generischer Ratschlaege geben.

Inhalte, die um “Wenn Sie sich in Situation X befinden, dann ist der beste Ansatz Y, weil Z” strukturiert sind, performen bei KI-Zitaten weit besser als Inhalte, die um “Der beste Ansatz ist Y” aufgebaut sind. Der situative Kontext gibt der KI die Zuversicht, dass Ihre Antwort auf die spezifische Nutzerfrage zutrifft, die sie gerade verarbeitet.

Das bedeutet auch, dass Long-Tail-, fragenbasierte Inhalte wertvoller sind als je zuvor. FAQ-Abschnitte, detaillierte How-to-Anleitungen und szenariospezifische Empfehlungen geben KI-Systemen genau die strukturierten, situationsbewussten Inhalte, die sie für die Generierung akkurater, zitierter Antworten benötigen.

Die Antwort werden

Im Jahr 2026 geht es bei Sichtbarkeit nicht mehr darum, einer von zehn Links auf einer Seite zu sein. Es geht darum, die definitive Antwort in einer fragmentierten Landschaft von LLMs zu sein. Ob ChatGPT, Gemini oder Perplexity, diese Systeme suchen nach strukturierten, frischen und autoritativen Inhalten, die sie ihren Nutzern gegenüber rechtfertigen können.

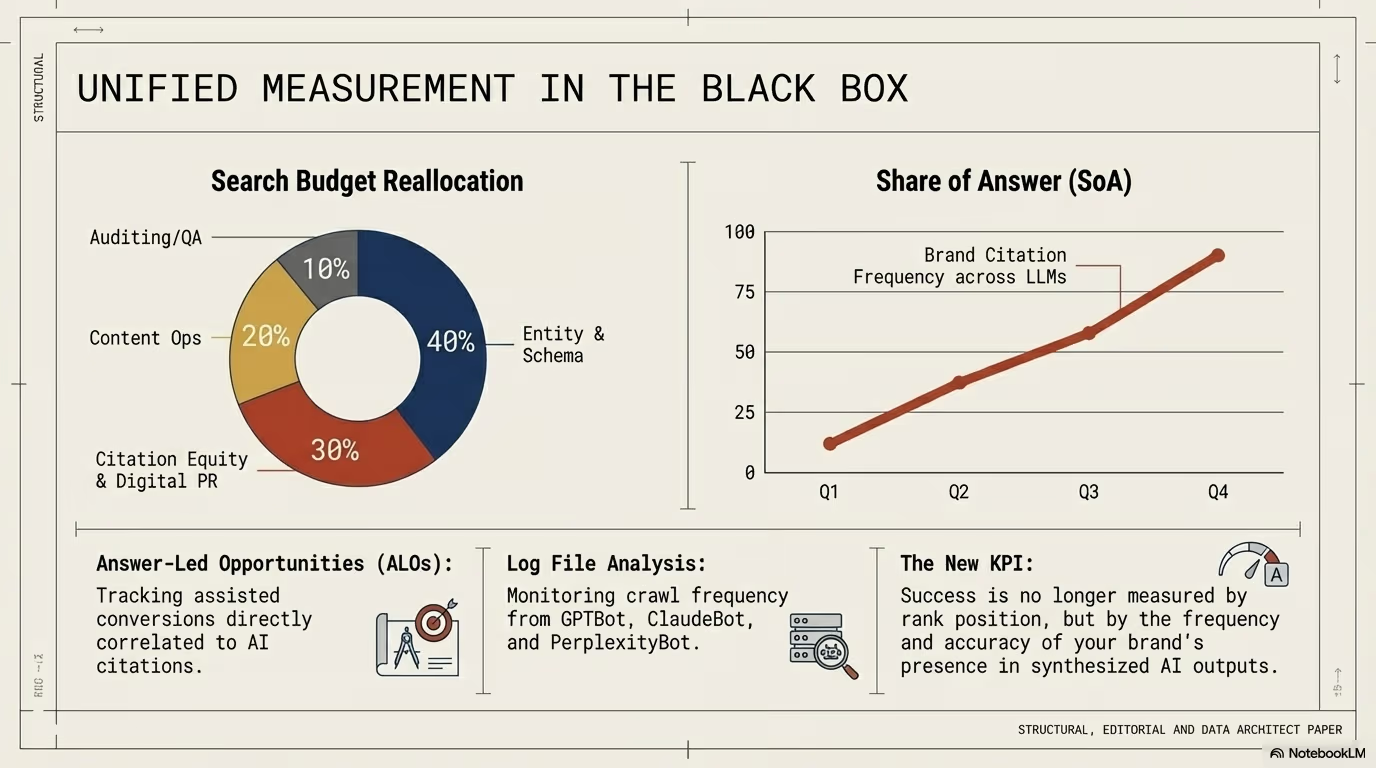

Der Übergang zu GEO erfordert einen Schwenk vom Klick-Jagen zum Besitz des Zitats. Dies ist nicht nur eine taktische Anpassung. Es ist eine strategische Neuausrichtung, die Content-Erstellung, technische Infrastruktur, digitale PR und Erfolgsmessung betrifft.

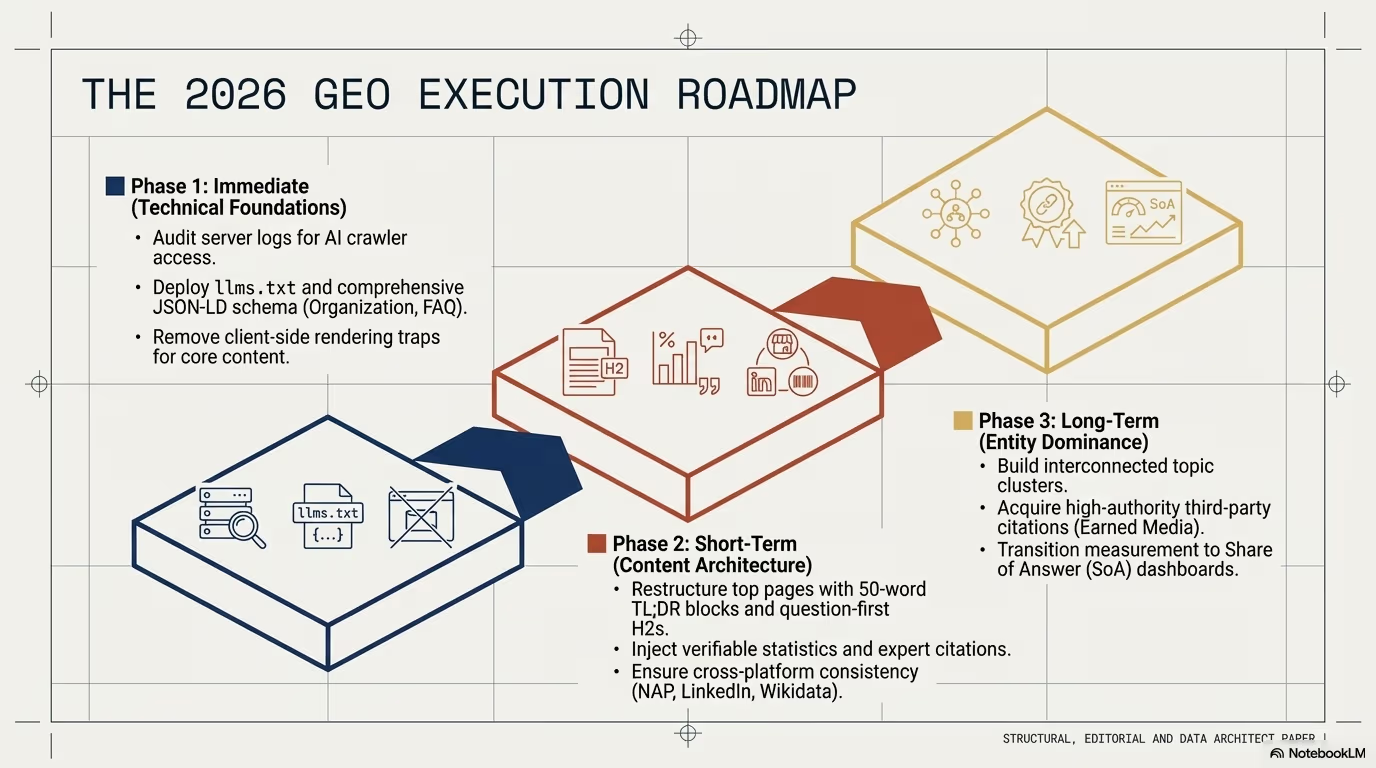

Die sieben in diesem Artikel dargelegten Wahrheiten bilden ein umsetzbares Rahmenwerk:

- Inhalte für die Extraktion strukturieren: Platzieren Sie Ihre zitationswuerdigsten Fakten in den ersten 200 Wörtern und bauen Sie eine Antwort-zuerst-Architektur auf, die RAG-Systeme effizient verarbeiten können.

- Strategien entkoppeln: Erkennen Sie, dass SEO und GEO parallele, aber unterschiedliche Optimierungsziele sind, und investieren Sie in beide.

- Thematische Autoritaetsnetze aufbauen: Erstellen Sie vernetzte Content-Oekosysteme mit fuenf oder mehr Seiten pro Themencluster, verbunden durch bidirektionale interne Links und Entity-Markup.

- Einen 90-Tage-Aktualisierungszyklus einhalten: Behandeln Sie jeden Inhält als lebendiges Dokument, das vierteljährliche Updates mit echten neuen Informationen und verifizierten Daten erfordert.

- In die Legitimitaetsschicht investieren: Bauen Sie Praesenz auf autoritativen Drittanbieter-Plattformen auf, denen KI-Systeme bereits vertrauen, und schaffen Sie die Vertrauenssignale, die für direkte Zitation benötigt werden.

- Den /llms.txt-Standard implementieren: Geben Sie KI-Systemen einen sauberen, strukturierten Einstiegspunkt zu Ihrer Expertise durch maschinenoptimierte Inhaltszusammenfassungen.

- Für Absicht schreiben, nicht für Keywords: Erstellen Sie situationsbewusste Inhalte, die zu den konversationellen, kontextuellen Anfragen passen, die Nutzer an KI-Systeme stellen.

Wenn wir tiefer in diese KI-first-Ära eintauchen, müssen Unternehmensfuehrer sich einer neuen Realitaet von Messung und Wert stellen. Wenn ein Nutzer nie auf Ihre Website klickt, aber die Antwort Ihrer Marke von einer KI erhaelt, haben Sie dann trotzdem gewonnen, und wie werden Sie es messen?

Die Unternehmen, die diese Frage zuerst beantworten, werden das nächste Jahrzehnt der digitalen Strategie definieren. Neue Metriken entstehen: Zitationshäufigkeit über KI-Plattformen hinweg, Marken-Erwaenungssentiment in KI-generierten Antworten, Entity-Vertrauenswerte und Antwort-Eigentumsraten für Schluesselanfragen. Diese Metriken werden irgendwann so selbstverstaendlich sein wie organischer Traffic und Konversionsraten heute.

Das Ende des Klicks ist nicht das Ende der Sichtbarkeit. Es ist der Beginn einer neuen Art von Einfluss, bei dem es wertvoller ist, die vertrauenswürdige Quelle zu sein, die KI zitiert, als der Link zu sein, auf den ein Nutzer klickt. Die Organisationen, die diesen Wandel verstehen und jetzt darauf reagieren, werden die wertvollste Immobilie in der digitalen Wirtschaft besitzen: die Antwort selbst.